OpenAI lancia GPT-5.4: computer use nativo, contesto da 1M di token e benchmark “superumani”

Con il rilascio di GPT-5.4, OpenAI compie un ulteriore passo nell’evoluzione dei modelli linguistici di frontiera destinati a contesti professionali. L’azienda guidata da Sam Altman presenta questa nuova generazione come il sistema più avanzato e allo stesso tempo più efficiente della propria linea di modelli, progettato per affrontare attività complesse che richiedono ragionamento strutturato, analisi approfondite e produzione di contenuti articolati.

Il modello viene proposto in più varianti pensate per differenti scenari operativi. Accanto alla versione standard, OpenAI ha introdotto GPT-5.4 Thinking, orientato ai processi di ragionamento esplicito e alle attività multi-step, e GPT-5.4 Pro, una configurazione ottimizzata per prestazioni elevate e maggiore velocità di elaborazione nei contesti più esigenti. Questa differenziazione riflette una strategia ormai consolidata nel settore dell’intelligenza artificiale, dove lo stesso modello di base viene declinato in versioni specializzate per rispondere a esigenze applicative diverse.

Uno degli elementi tecnicamente più rilevanti riguarda la dimensione della finestra di contesto disponibile tramite API. GPT-5.4 può infatti gestire sequenze fino a un milione di token, una soglia estremamente ampia rispetto agli standard precedenti. In termini pratici, significa poter elaborare quantità di informazioni molto più estese all’interno di una singola richiesta, in modo che documenti complessi, grandi archivi di testo, intere basi di codice o dataset articolati possano essere analizzati senza dover ricorrere a segmentazioni artificiali.

Per sviluppatori e aziende che integrano modelli AI nei propri workflow, questa caratteristica rappresenta un vantaggio concreto nella gestione di applicazioni avanzate di analisi documentale o automazione del knowledge work.

Parallelamente, OpenAI sottolinea i miglioramenti ottenuti sul piano dell’efficienza dei token. Il nuovo modello sarebbe in grado di risolvere gli stessi problemi utilizzando una quantità significativamente inferiore di token rispetto alla generazione precedente, riducendo quindi il costo computazionale delle richieste e migliorando la rapidità delle risposte. In ambienti dove il modello viene interrogato su larga scala attraverso API, questa ottimizzazione ha un impatto diretto sui costi operativi.

I risultati nei benchmark pubblici contribuiscono a delineare il posizionamento di GPT-5.4 nel panorama attuale dei modelli di frontiera. Il sistema ha ottenuto punteggi record nei test dedicati all’interazione con sistemi informatici come OSWorld-Verified e WebArena Verified, benchmark progettati per valutare la capacità dei modelli di operare in ambienti software simulati. In queste prove, l’AI deve completare compiti complessi che richiedono sequenze di azioni coerenti come navigare interfacce, eseguire operazioni o gestire strumenti digitali.

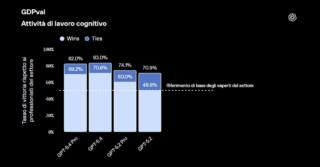

Un altro risultato rilevante riguarda il test GDPval sviluppato internamente da OpenAI per valutare le competenze nei cosiddetti knowledge work tasks, attività tipiche del lavoro intellettuale. GPT-5.4 ha raggiunto un punteggio dell’83%, il più alto registrato finora per questo benchmark.

Un’area di sviluppo centrale per OpenAI riguarda la riduzione delle “allucinazioni”. Nei test comparativi interni, GPT-5.4 risulterebbe il 33% meno incline a commettere errori in singole affermazioni rispetto alla versione 5.2. Considerando poi l’intera risposta, la probabilità complessiva di imprecisioni sarebbe stata ridotta del 18%, un progresso significativo per applicazioni dove l’affidabilità delle informazioni è un requisito fondamentale.

Contestualmente al lancio del modello, OpenAI ha introdotto anche alcune modifiche strutturali al funzionamento dell’API. Una delle novità più interessanti è il sistema denominato Tool Search, progettato per migliorare la gestione degli strumenti esterni utilizzati dal modello. In passato, le definizioni di tutti i tool disponibili venivano incluse nel prompt di sistema prima dell’esecuzione della richiesta. Questo approccio diventava progressivamente inefficiente quando il numero di strumenti cresceva, poiché richiedeva un grande consumo di token.

Con Tool Search, il modello può invece recuperare dinamicamente le informazioni sugli strumenti solo quando necessario. Questo meccanismo riduce il volume di dati inseriti nel prompt iniziale e rende le chiamate API più veloci ed economiche, soprattutto nelle applicazioni che integrano numerosi strumenti operativi.

Sul fronte della sicurezza e della trasparenza del ragionamento, OpenAI ha inoltre sviluppato una nuova metodologia di valutazione per analizzare il cosiddetto chain-of-thought, ovvero la sequenza di passaggi logici che i modelli possono esporre durante la risoluzione di problemi complessi. Alcuni ricercatori nel campo della sicurezza dell’AI hanno espresso preoccupazioni sul fatto che modelli avanzati possano potenzialmente manipolare o nascondere questa sequenza di ragionamento.

I test condotti dall’azienda indicano che la versione GPT-5.4 Thinking presenta una minore propensione a comportamenti di questo tipo. Secondo OpenAI, i risultati suggeriscono che il modello non possiede capacità efficaci per occultare deliberatamente il proprio processo di ragionamento, confermando quindi l’utilità del monitoraggio del chain-of-thought come strumento di sicurezza e analisi del comportamento dei modelli di nuova generazione.