OpenAI “assume” Gimlet Labs per fare inferenza su chip Cerebras 10 volte più veloce di Nvidia

Per anni, l’infrastruttura dell’intelligenza artificiale ha avuto nelle GPU Nvidia un unico punto di riferimento quasi obbligato grazie a un ecosistema maturo, a un software rodato come CUDA e a una catena di fornitura consolidata. La recente corsa agli “armamenti computazionali” ha però messo sotto pressione questo modello in modo sempre più evidente. L’accesso alle GPU H100 e H200 è infatti diventato un collo di bottiglia reale per i principali laboratori AI, con tempi di attesa e costi che non sono più compatibili con la velocità di sviluppo che il mercato impone.

OpenAI ha risposto a questa pressione in modo pragmatico e, invece di aspettare che l’offerta Nvidia si adeguasse alla domanda, ha iniziato a costruire una strategia parallela basata su architetture hardware alternative. Al centro di questa strategia ci sono ora Cerebras, produttore americano di chip specializzati per l’AI, e Gimlet Labs, startup fino a poco tempo fa poco conosciuta al grande pubblico.

Il lavoro di Gimlet Labs non riguarda la ricerca di base né lo sviluppo di nuovi modelli. Si tratta di ingegneria profonda e molto specifica che punta ad adattare il codice dei modelli esistenti affinché girino in modo efficiente su architetture chip diverse da quelle per cui erano stati originariamente progettati. Un compito che appare banale solo a chi non ha mai messo mano a un pipeline di training o inferenza su hardware non standard.

Ottimizzare un modello per un chip diverso significa riscrivere parti critiche del codice di basso livello, ricalibrare le operazioni tensoriali e gestire diversamente la memoria e la larghezza di banda. È un lavoro che richiede competenze di systems engineering raramente disponibili internamente anche nei team più grandi. OpenAI ha quindi esternalizzato questa componente tecnica e il risultato è già visibile considerando che Codex-Spark, la versione accelerata del tool di programmazione assistita di OpenAI, gira oggi su infrastruttura Cerebras grazie proprio all’intervento di Gimlet Labs.

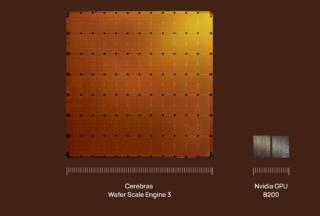

Ciò che rende questa notizia rilevante, oltre alle implicazioni tecnologiche (Gimlet Labs parla di un throughput inferenziale fino a 10 volte più veloce a parità di costo e consumo rispetto all’ecosistema Nvidia), è la sua ampia implicazione strategica. La diversificazione dei chip non è più una sperimentazione di nicchia, ma sta diventando un requisito operativo per chiunque voglia costruire o scalare sistemi AI senza restare ostaggio di un unico fornitore.

Meta, per esempio, ha già comunicato pubblicamente la propria intenzione di ridurre la dipendenza da Nvidia espandendo l’uso di chip proprietari e alternativi. Altri player di simile importanza si stanno muovendo nella stessa direzione, anche se con minore visibilità pubblica, rendendo evidente un pattern per cui la fase in cui bastava scegliere il modello giusto e comprare GPU è finita. Oggi chi costruisce infrastruttura AI, deve pianificare la compatibilità multi-architettura fin dalla fase di design.

Per gli operatori e i decision maker aziendali, questa evoluzione apre scenari precisi. Da un lato, produttori come Cerebras, che hanno chip tecnicamente competitivi ma hanno faticato a scalare l’adozione enterprise per mancanza di un ecosistema software maturo, trovano ora un percorso più credibile verso il mercato. Le partnership con specialisti di ottimizzazione come Gimlet Labs abbassano la barriera d’ingresso per i clienti finali, che non devono più sobbarcarsi internamente il costo di porting e tuning.

Dall’altro lato, emerge con chiarezza una nuova categoria di servizi ad alto valore rappresentata dall’ottimizzazione hardware-specifica dei modelli AI. Le aziende che distribuiscono modelli in produzione a scala significativa dovranno mettere in conto questo tipo di lavoro come voce strutturale del loro budget tecnologico e non più come spesa una tantum. Ecco perché chi saprà offrire questo servizio in modo affidabile e riproducibile (startup focalizzate, system integrator evoluti, divisioni specializzate dei grandi cloud provider), si troverà di fronte a un’opportunità di mercato concreta e ancora poco affollata.

(Immagine in apertura: Shutterstock)