Microsoft MAI: tre nuovi modelli AI per text to speech, speech to text e generazione di immagini

Microsoft ha annunciato il lancio in anteprima pubblica di tre modelli AI sviluppati internamente (MAI-Transcribe-1, MAI-Voice-1 e MAI-Image-2).

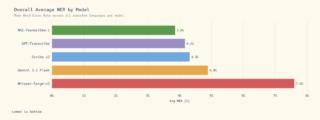

MAI-Transcribe-1 è un sistema di riconoscimento vocale che l’azienda posiziona come soluzione enterprise, con supporto per 25 lingue e un costo computazionale dichiarato inferiore di circa il 50% rispetto alle alternative principali sul mercato. MAI-Voice-1, il modello di sintesi vocale, è in grado di generare 60 secondi di audio in meno di un secondo su una singola GPU, una prestazione che lo rende adatto a scenari in cui la latenza è un fattore critico, come i sistemi di assistenza clienti in tempo reale. MAI-Image-2 completa la triade occupandosi della generazione di immagini a partire da testo.

I tre modelli sono disponibili esclusivamente attraverso Microsoft Foundry, la piattaforma di sviluppo per agenti e applicazioni AI precedentemente nota come Azure AI Studio. Non si tratta di novità assolute per l’infrastruttura Microsoft (questi sistemi alimentano già prodotti come Copilot, Bing, PowerPoint e Azure Speech), ma per la prima volta vengono messi nelle mani degli sviluppatori esterni.

La sovrapposizione con il portfolio di LLM di OpenAI è difficile da ignorare. L’azienda fondata da Sam Altman offre già i propri modelli di trascrizione vocale, sintesi audio e generazione di immagini tramite API. Microsoft, che detiene una partecipazione in OpenAI valutata intorno ai 135 miliardi di dollari nell’ottobre scorso, si trova ora a competere direttamente con il proprio investimento, almeno sul piano dei prodotti per sviluppatori.

Questa tensione ha radici concrete. A gennaio, gli investitori di Microsoft avevano manifestato preoccupazione per l’esposizione finanziaria nei confronti di OpenAI, un’azienda che secondo proiezioni potrebbe bruciare 14 miliardi di dollari nel corso del 2026. Nel frattempo, quando Microsoft ha rinegoziato i termini del proprio accordo con OpenAI, ha inserito come clausola la possibilità di perseguire autonomamente la ricerca sull’IA generale, da sola o con partner terzi.

Le recenti mosse sul fronte della leadership interna rafforzano questa lettura. Due settimane fa, Satya Nadella (CEO di Microsoft) ha annunciato una riorganizzazione significativa dell’area Copilot, strutturandola attorno a quattro assi (experience, platform, Microsoft 365 apps e AI models), con l’ultimo pilastro che difficilmente si esaurirà in questi tre modelli MAI.

Il fatto che Mustafa Suleyman, cofondatore di DeepMind e figura di spicco nella ricerca AI globale, continui a guidare la ricerca sull’intelligenza artificiale di Microsoft è un ulteriore indicatore, visto che tenere in casa una delle menti più influenti del settore non avrebbe senso se l’ambizione fosse quella di rimanere dipendenti da un fornitore esterno come OpenAI.

Sul piano applicativo, i tre modelli si prestano a scenari enterprise ben definiti:

- MAI-Transcribe-1 trova applicazione naturale nella trascrizione di riunioni, nella produzione di sottotitoli per eventi dal vivo, nell’archiviazione di contenuti multimediali e nell’analisi qualitativa di focus group e interviste

- MAI-Voice-1 è già il motore di Audio Expressions in Copilot e della modalità vocale di trascrizione, il che significa che Microsoft sta già scommettendo su questo modello in prodotti con milioni di utenti attivi

- MAI-Image-2 si rivolge a chi sviluppa applicazioni creative, strumenti di marketing o interfacce visive generate dinamicamente

La disponibilità tramite Azure Speech consente inoltre agli sviluppatori di integrare i modelli di trascrizione e sintesi vocale in flussi di lavoro esistenti senza dover abbandonare l’ecosistema Azure. È una strategia di lock-in morbido coerente con il modo in cui Microsoft ha sempre costruito i propri vantaggi competitivi, ovvero rendere la propria infrastruttura la scelta più conveniente per chi è già dentro.

(Immagine in apertura: Shutterstock)