Kimi K2.6 è l’LLM open weights che compete con i modelli di frontiera: opzione per la private AI?

La startup cinese Moonshot AI ha reso disponibile su Hugging Face Kimi-K2.6, l’ultima evoluzione della sua famiglia di modelli linguistici open-source che, stando alle dichiarazioni ufficiali, supera GPT-5.4 e Claude Opus 4.6 su una serie di benchmark consolidati, posizionandosi come uno dei più competitivi nella fascia frontier dell’IA generativa accessibile al pubblico.

Per capire cosa distingue Kimi-K2.6 dai suoi predecessori, vale la pena partire dalle scelte architetturali. Il modello adotta SwiGLU (Swish-Gated Linear Unit), un algoritmo che rispetto alle soluzioni più datate riduce il carico computazionale durante il training e risulta più compatibile con l’hardware moderno. Non è una novità assoluta nel panorama open-source (Meta l’ha già integrata nella serie Llama), ma la sua presenza in Kimi-K2.6 conferma che sta diventando uno standard de facto per chi costruisce LLM di nuova generazione.

Sul fronte dell’attenzione, il modello implementa MLA (Multi-head Latent Attention), una variante più efficiente del meccanismo di attenzione standard. Il principio di funzionamento rimane lo stesso, ovvero identificare le parti più rilevanti di un prompt per orientare la generazione della risposta. La differenza sta nel modo in cui i dati vengono trattati internamente: MLA li comprime in rappresentazioni matematiche leggere prima di elaborarli, abbattendo i requisiti hardware senza sacrificare la qualità del ragionamento.

Kimi-K2.6 adotta inoltre un’architettura Mixture of Experts (MoE) con 384 reti neurali specializzate, ciascuna ottimizzata per una categoria diversa di compiti. Durante l’inferenza, il modello ne attiva solo otto per ogni risposta generata e questo approccio selettivo, comune ai modelli MoE di ultima generazione, consente di distribuire la competenza su un numero molto elevato di parametri totali, mantenendo però basso il costo computazionale effettivo per ogni singola query.

A completare il quadro c’è un vision encoder da 400 milioni di parametri, responsabile della conversione delle immagini in embedding comprensibili dal modello. Questa componente rende Kimi-K2.6 un sistema multimodale a tutti gli effetti, capace di elaborare prompt che combinano testo e contenuti visivi.

Alcune delle caratteristiche più interessanti di Kimi-K2.6 riguardano il suo comportamento in contesti di automazione complessa. Il modello può infatti orchestrare fino a 300 agenti in parallelo per gestire task articolati, suddividendo il lavoro in sottofasi eseguite simultaneamente. Per chi lavora su pipeline di automazione o sviluppo software, questa scalabilità orizzontale può tradursi in riduzioni concrete dei tempi di esecuzione.

C’è poi la funzionalità denominata “claw groups”, che introduce un meccanismo ibrido per la distribuzione del lavoro tra agenti automatici e operatori umani. Moonshot AI la presenta come uno strumento per mantenere supervisione umana nei punti critici di un flusso di lavoro, delegando all’automazione le fasi più ripetitive o parallelizzabili. Il modello mostra anche miglioramenti nel supporto a Rust, linguaggio a basso livello notoriamente ostico per la sua sintassi rigorosa e ampiamente utilizzato nello sviluppo di sistemi embedded e dispositivi connessi.

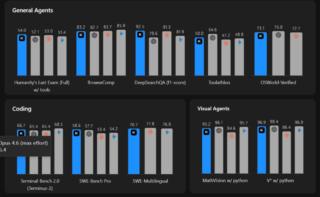

Il confronto con GPT-5.4 e Claude Opus 4.6 copre oltre venti benchmark standard. Kimi-K2.6 supera entrambi i modelli o si avvicina ai loro punteggi nella grande maggioranza dei test considerati. Il risultato più emblematico arriva da HLE-Full, uno degli strumenti di valutazione più severi dell’intero ecosistema AI (circa 2.500 domande a livello dottorale distribuite su oltre 100 discipline accademiche). Kimi-K2.6 ha ottenuto 54 punti, contro i 53 di Claude Opus 4.6 e i 52,1 di GPT-5.4; margini sottili, ma sufficienti a stabilire una gerarchia su un benchmark dove anche frazioni di punto riflettono differenze sostanziali nelle capacità di ragionamento avanzato.