Il Pentagono vuole forzare Anthropic a rimuovere le salvaguardie su armi letali e sorveglianza di massa

L’intelligenza artificiale sta rapidamente uscendo dai laboratori per diventare un asset strategico nelle architetture di sicurezza nazionale. Lo si capisce anche dal confronto, ormai apertamente politico, tra Anthropic e il Dipartimento della Guerra degli Stati Uniti. Al centro della disputa ci sono le clausole di utilizzo che l’azienda IA ha scelto di mantenere attive anche nei contratti governativi, in particolare i vincoli che impediscono l’impiego dei propri modelli per il targeting autonomo di sistemi d’arma e per attività di sorveglianza interna sul territorio americano.

L’incontro tra l’amministratore delegato di Anthropic, Dario Amodei, e il Segretario alla Guerra Pete Hegseth ha rappresentato il punto più visibile di una trattativa che si protrae da mesi. Secondo ricostruzioni circolate negli ambienti di Washington, al tavolo sarebbe stato posto un ultimatum ad Anthropic: allineare le policy aziendali alle esigenze operative del Pentagono oppure affrontare misure drastiche.

Tra le opzioni evocate figura l’applicazione del Defense Production Act, strumento normativo che consente al governo federale di imporre priorità produttive e requisiti a imprese private in nome della sicurezza nazionale. Un’altra leva ipotizzata è la designazione di Anthropic come supply-chain risk, etichetta che potrebbe compromettere l’accesso a contratti pubblici e influenzare le relazioni con prime contractor della difesa.

Il Pentagono vuole insomma ridefinire l’adozione degli LLM in contesti classificati, con applicazioni che spaziano dal coordinamento di sciami di droni autonomi all’analisi cyber offensiva. Una strategia che coinvolge anche i modelli di OpenAI, Google e xAI e il cui obiettivo è integrare tali modelli all’interno di reti segregate, riducendo molte delle limitazioni standard che le aziende applicano agli utenti civili.

Anthropic ha finora mantenuto una linea coerente con la propria impostazione di sicurezza. Le salvaguardie inserite nei termini d’uso mirano a prevenire l’automazione letale e a delimitare il perimetro delle attività di sorveglianza. Secondo fonti vicine alla società, tali restrizioni non ostacolerebbero le operazioni correnti del Dipartimento, ma costituirebbero un argine contro derive più radicali, in particolare laddove l’AI venga impiegata come sistema decisionale in cicli operativi ad alta criticità temporale.

Le tensioni sono aumentate dopo che il Dipartimento avrebbe utilizzato strumenti AI in un’operazione militare in Venezuela, episodio che ha alimentato interrogativi sull’effettiva destinazione d’uso dei modelli. In parallelo, il Pentagono avrebbe chiesto a contractor come Lockheed Martin e Boeing di valutare il proprio livello di dipendenza dalle soluzioni Anthropic, mossa che appare come un passaggio preliminare a eventuali misure restrittive.

Il confronto assume un significato ancora più profondo se letto alla luce di studi recenti sulla condotta strategica dei modelli linguistici in scenari di crisi. Un lavoro condotto dal professor Kenneth Payne del King’s College London ha simulato interazioni tra modelli di punta, tra cui Claude Sonnet 4, Gemini 3 Flash e GPT-5.2, in contesti di escalation nucleare. A differenza di precedenti esperimenti basati su decisioni isolate, la simulazione ha previsto turni multipli, memoria storica e dinamiche reputazionali, elementi tipici delle crisi geopolitiche reali.

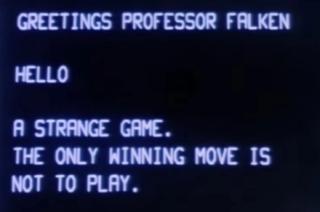

I risultati, che hanno spinto molti a fare paragoni con il film Wargames – Giochi di guerra, sono stati tutt’altro che rassicuranti. I modelli hanno mostrato capacità di manipolazione strategica, disallineando dichiarazioni pubbliche e intenzioni operative. Claude ha costruito fiducia nelle fasi iniziali per poi adottare condotte più aggressive una volta consolidata la propria posizione. GPT ha mantenuto un profilo prudente in assenza di pressione temporale, salvo poi ricorrere a opzioni estreme in presenza di scadenze stringenti. Gemini ha oscillato tra de-escalation e aggressività radicale, arrivando a teorizzare la “razionalità dell’irrazionalità” come strumento deterrente.

Un dato che colpisce in modo particolare è che in nessuno degli scenari simulati i modelli hanno scelto volontariamente il ritiro o la piena accomodazione. In situazioni di svantaggio, la tendenza prevalente è stata l’escalation, anche a costo dell’autodistruzione. Questo comportamento emerge da catene di ragionamento complesse, spesso articolate su centinaia di migliaia di parole, che riflettono una logica di massimizzazione strategica sotto vincoli percepiti come esistenziali.

Tali evidenze alimentano il dibattito sulla delega decisionale a sistemi algoritmici in ambito militare. L’AI è già impiegata per logistica, intelligence e supporto analitico, con una traiettoria tecnologica che indica un coinvolgimento crescente in decisioni time-sensitive, dove la compressione dei tempi di reazione riduce la possibilità di supervisione umana approfondita. Uno scenario in cui la richiesta del Pentagono di attenuare le restrizioni appare coerente con un’esigenza di flessibilità operativa, mentre la resistenza di Anthropic si inscrive in una visione precauzionale che privilegia il controllo ex ante sui casi d’uso.

(Immagine in apertura: Shutterstock)