Con GPT-5, OpenAI abbandona l’idea di avere un unico, enorme, modello monolitico

OpenAI ha svelato ieri GPT-5, definendolo il suo modello più potente fino ad oggi. Il CEO Sam Altman lo ha descritto come l’equivalente “parlare con un esperto personale capace di scrivere applicazioni su richiesta” e, rispetto alle versioni precedenti, GPT-5 promette miglioramenti tangibili in programmazione, scrittura, matematica e percezione visiva, riducendo al contempo le allucinazioni e i comportamenti ingannevoli.

Una famiglia di modelli, non uno solo

Una delle novità più interessanti è che GPT-5 non è un unico modello monolitico, ma un insieme di modelli coordinati che utilizza un sistema di routing in grado di decidere quale versione attivare in base alla complessità del prompt e all’intento dell’utente.

I prompt semplici sono infatti inviati a un modello leggero e veloce, mentre i compiti complessi sono gestiti da un modello più profondo e dotato di capacità di reasoning avanzato (gli utenti a pagamento potranno anche forzare l’attivazione permanente della modalità di ragionamento). Questo sistema di smistamento è addestrato continuamente su nuovi segnali, per migliorare nel tempo la capacità di capire quando e come impiegare la potenza di calcolo extra.

I modelli che compongono GPT-5 sono quattro:

- GPT-5 standard: il modello base, bilanciato tra velocità e capacità, disponibile per utenti Free e Plus

- GPT-5 mini: una versione più leggera e veloce, pensata per risposte rapide a richieste semplici, anch’essa accessibile agli utenti Free e Plus

- GPT-5 Pro: la versione più potente, con capacità avanzate di ragionamento e gestione di compiti complessi, disponibile per utenti Pro ed Enterprise

- GPT-5 Nano: una versione molto piccola ed economica, disponibile tramite API, ideale per chi cerca un modello efficiente a basso costo

Un altro punto chiave è l’efficienza: “GPT-5 ottiene più valore con meno tempo di ragionamento”, ha dichiarato Altman. Secondo le valutazioni interne, GPT-5 con thinking mode attivo supera il modello o3 in ambiti come ragionamento visivo, agentic coding e risoluzione di problemi scientifici avanzati, usando dal 50% all’80% in meno di token di output.

Rivoluzione o semplice evoluzione?

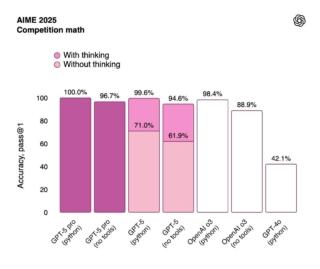

Dietro le dichiarazioni roboanti, i benchmark raccontano in realtà una realtà un po’ più sobria. Nel benchmark matematico AIME 2025, GPT-5 Pro supera o3 di soli 1,6 punti con uso di strumenti e 7,8 punti senza. Per gli utenti gratuiti, però, il salto rispetto a GPT-4o è consistente: +57,5 punti e tendenze simili si osservano anche nei test FrontierMath e HMMT.

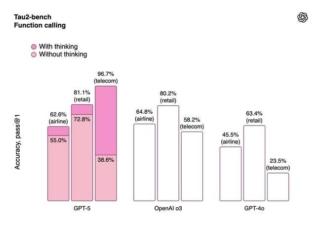

Lo stesso scenario si presenta nei quiz scientifici GPQA Diamond e Humanity’s Last Exam, con vantaggi a una cifra percentuale rispetto al modello precedente. L’eccezione notevole è il Tau2-bench, che misura l’uso di strumenti e la capacità di seguire istruzioni: qui GPT-5 ha dimostrato miglioramenti significativi.

Greg Brockman, presidente di OpenAI, ha commentato: “I benchmark sono importanti, ma stiamo raggiungendo un livello di saturazione: quando passi dal 98% al 99%, servono nuovi modi per valutare la qualità del modello.”

L’importanza crescente del coding

Incalzata dai modelli più avanzati di Anthropic, GPT-5 porta miglioramenti anche nella capacità di scrivere e ragionare sul codice rispetto alle versioni precedenti. Grazie a una maggiore profondità di ragionamento, il modello è in grado di affrontare progetti di sviluppo più complessi, pianificando con più precisione i passaggi necessari senza perdere il filo logico.

Secondo OpenAI, GPT-5 eccelle anche nell’integrazione e nell’uso di strumenti esterni, come debugger o API, migliorando la sua capacità di eseguire task complessi in modo più autonomo e affidabile. In particolare, GPT-5 supporta al meglio l’“agentic coding”, ovvero la possibilità di operare come un assistente programmativo che non si limita a scrivere righe di codice, ma che può anche testare, correggere e perfezionare un’applicazione in modo iterativo.

Focus su salute e applicazioni pratiche

Nel corso della presentazione, Altman ha sottolineato in particolare le prestazioni di GPT-5 nel campo (sempre molto rischioso) della salute: “Uno dei principali usi di ChatGPT è proprio la salute e GPT-5 è il miglior modello di sempre per questo scopo”, ha dichiarato il CEO di OpenAI.

Durante l’evento, Altman ha mostrato esempi di utenti che caricano documenti medici per ricevere analisi dettagliate dal modello. Un approccio dal forte impatto ma che solleva interrogativi sulla gestione di dati sensibili e sul solito rischio di allucinazioni, che in ambito medico assume ancora più rilevanza.

Proprio su questo versante, uno degli obiettivi di GPT-5 è ridurre drasticamente la tendenza a “inventare” fatti. OpenAI parla di −45% di errori fattuali rispetto a GPT-4o e di −80% di errori rispetto a o3 quando è attivo il thinking mode. Il modello inoltre riconosce meglio i limiti delle proprie capacità, evitando di mentire per compiacere l’utente. Nei test interni, la percentuale di risposte ingannevoli è scesa dal 4,8% di o3 al 2,1% in GPT-5.

Sicurezza: meno divieti ciechi, più risposte responsabili

Sul fronte sicurezza, OpenAI ha abbandonato l’approccio “blocco totale” a favore di risposte complete ma sicure. Ad esempio, se si chiede come maneggiare un composto pericoloso, GPT-5 non si limiterà a rifiutare, ma fornirà avvisi e indicherà fonti affidabili.

Passando a ChatGPT, arrivano quattro nuove personalità opzionali: Cynic (cinico), Robot (formale e neutro), Listener (empatico) e Nerd (entusiasta di dettagli tecnici). Per ora questi quattro approcci sono disponibili solo in chat testuale, ma OpenAI promette di portarle anche nelle voci. Lo scopo, secondo Mark Chen, Chief Research Officer, è “rendere l’interazione più vicina allo stile comunicativo dell’utente”.

Il lancio di GPT-5 arriva in una settimana a dir poco calda per il settore degli LLM. Google continua a fare evolvere Gemini con annunci quasi settimanali e Anthropic ha annunciato proprio due giorni fa Claude Opus 4.1, anch’esso con miglioramenti incrementali nelle prestazioni di coding, a conferma di come la corsa dell’IA stia entrando in una fase di ottimizzazioni più che di salti quantici.