Bonsai 8B: l’LLM a 1 bit che sfida i giganti del mercato puntando sull’IA in locale

PrismML, startup nata in seno al California Institute of Technology, sta mettendo in discussione con un approccio radicale alla quantizzazione dei modelli linguistici l’assunto per il quale, in ambito IA, più grande ha quasi sempre significato migliore. Il suo primo prodotto pubblico, Bonsai 8B, è un LLM a 1 bit capace di occupare appena 1,15 GB di memoria, mantenendo al tempo stesso prestazioni competitive rispetto a modelli di dimensioni ben superiori.

Per capire la portata di questo risultato, è necessario fare un passo indietro. I modelli basati sull’architettura Transformer sono reti neurali composte da milioni o miliardi di pesi, parametri numerici che determinano la forza delle connessioni tra neuroni e, in ultima analisi, la capacità del modello di eseguire ragionamenti complessi.

La precisione con cui questi pesi vengono rappresentati in memoria ha un impatto diretto sia sulle dimensioni del modello, sia sulle sue prestazioni. Un modello a 16 bit (FP16) occupa molto più spazio di uno a 8 o 4 bit, ma tende a ragionare meglio. Scendere di precisione ha storicamente significato accettare compromessi pesanti in termini di qualità delle risposte, soprattutto quando si tratta di seguire istruzioni articolate, ragionare su più passaggi o utilizzare strumenti esterni.

Bonsai 8B rompe questa equazione. Nell’architettura sviluppata da PrismML, ogni peso è ridotto a un semplice segno, +1 o -1, affiancato da un fattore di scala condiviso per ogni gruppo di parametri. Non è una quantizzazione aggressiva nel senso tradizionale del termine, ma una ridefinizione matematica di come un modello neurale può essere compresso senza perdere le sue capacità di reasoning.

Il fondamento teorico di questo lavoro è stato sviluppato nell’arco di anni dal professor Babak Hassibi, docente di ingegneria elettrica al Caltech e oggi CEO di PrismML, insieme al suo gruppo di ricerca. La strada era già stata tracciata da contributi accademici come il paper BitNet del 2017 e il più recente The Era of 1-bit LLMs del 2024, ma la traduzione in un prodotto funzionante e competitivo rappresenta un salto qualitativo significativo.

I numeri riportati da PrismL sono notevoli. Rispetto ai modelli a precisione intera della stessa classe parametrica, Bonsai 8B è infatti 14 volte più piccolo, 8 volte più veloce e consuma cinque volte meno energia su hardware edge. Su benchmark consolidati come MMLU Redux, MuSR e GSM8K, le prestazioni rimangono competitive con Qwen3 8B, che tuttavia lo supera di poco.

Il confronto più interessante emerge però quando si introduce la metrica dell'”intelligence density”, proposta dalla stessa PrismML come nuovo standard di valutazione per indicare il rapporto tra capacità effettiva e dimensioni del modello. Su questa metrica, Bonsai 8B ottiene 1,06 per gigabyte contro lo 0,10 di Qwen3 8B, un divario che difficilmente può essere liquidato come semplice esercizio di marketing.

La vera ambizione del progetto, però, va oltre il benchmark. L’industria AI è oggi fortemente dipendente dall’infrastruttura cloud, con tutto ciò che ne consegue in termini di latenza, costi, consumo energetico e rischi per la privacy. Modelli come Bonsai 8B aprono una strada concreta verso l’esecuzione locale dell’intelligenza artificiale su smartphone, dispositivi embedded, sistemi robotici in tempo reale e ambienti enterprise, dove i dati non possono lasciare il perimetro aziendale.

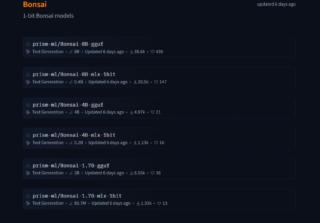

Il modello gira nativamente su piattaforma Apple Silicon tramite MLX e su GPU Nvidia via llama.cpp ed è già disponibile su HuggingFace con licenza Apache 2.0, insieme a due varianti ancora più compatte (Bonsai 4B e Bonsai 1.7B).

Hassibi ha dichiarato di considerare il traguardo del 1 bit non un punto di arrivo, ma un punto di partenza. La traiettoria che PrismML intende percorrere è quella di spostare il centro di gravità della conversazione sull’AI dall’ossessione per la scala bruta verso una nuova dimensione, concentrandosi su quanta intelligenza si riesce a estrarre per ogni watt consumato e per ogni byte occupato. Un cambio di prospettiva che ricorda, per certi versi, la rivoluzione del performance-per-watt nell’industria dei processori, che ha trasformato in modo irreversibile il design dei chip mobili.

(Immagine in apertura: Shutterstock)