A Google Cloud Next ’26: debuttano Gemini Enterprise Agent Platform, il Workspace Intelligence e le TPU di ottava generazione

Sono stati tre gli annunci principali rivelati ieri al Google Cloud Next 26. Il primo riguarda la nuova generazione (l’ottava) di TPU (Tensor Processing Unit), chip storicamente capaci di addestrare modelli di intelligenza artificiale e di gestire le richieste di inferenza degli utenti finali. Con la nuova generazione TPU 8, questa filosofia viene abbandonata e, a spiegarne il motivo, è stato Amin Vahdat, senior vice president e chief technologist per AI e infrastruttura di Google.

L’ascesa degli agenti AI ha reso evidente che i requisiti computazionali del training e quelli dell’inference sono così divergenti da richiedere hardware dedicato. Addestrare un modello è un processo intensivo, parallelo, che richiede di gestire enormi quantità di dati in batch e tollerare latenze relativamente alte. Servire quel modello in tempo reale a milioni di utenti simultanei è invece un problema completamente diverso dove la latenza è tutto e la risposta deve arrivare in millisecondi. Provare a ottimizzare un singolo chip per entrambi gli scenari significa, inevitabilmente, scendere a compromessi su entrambi.

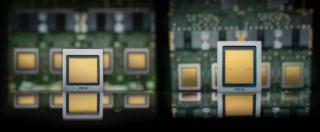

Cosa cambia con TPU 8

Il nuovo chip per il training (TPU 8t) porta con sé 2,8 volte la capacità della settima generazione Ironwood annunciata lo scorso novembre e lo fa a parità di costo. Il chip per l’inference, battezzato TPU 8i, vede invece un miglioramento delle prestazioni dell’80% rispetto al predecessore, anche se la differenza più significativa dal punto di vista architetturale riguarda la memoria.

La generazione TPU 8 integra infatti 384 megabyte di SRAM per chip, triplicando la quantità presente in Ironwood. La scelta non è casuale visto che la SRAM (memoria statica ad accesso casuale) è più veloce e a più bassa latenza rispetto alla DRAM tradizionale, oltre a essere la stessa architettura su cui puntano Cerebras (che ha presentato la domanda di IPO nelle scorse settimane) e il prossimo hardware Groq 3 LPU di Nvidia. Il fatto che Google, Nvidia e un’azienda indipendente come Cerebras convergano indipendentemente sulla stessa soluzione tecnica dice qualcosa di preciso sulla direzione in cui si sta muovendo l’industria dei chip per inferenza.

Sundar Pichai, CEO di Alphabet, ha descritto l’architettura del TPU 8i come progettata specificamente per “offrire il throughput massiccio e la latenza bassa necessari per eseguire concorrentemente milioni di agenti in modo economicamente sostenibile”. La parola chiave è “agenti”. Google non sta infatti costruendo infrastruttura per i modelli del presente, ma per lo scenario in cui miliardi di agenti AI autonomi opereranno in parallelo sulle sue cloud, ciascuno richiedendo risposte istantanee e continue.

Un’unica soluzione per gli agenti AI

La seconda novità è rappresentata da Gemini Enterprise Agent Platform, un’evoluzione dell’ecosistema Vertex AI che mira a unificare sviluppo, orchestrazione e governance degli agenti in un’unica soluzione integrata. La piattaforma nasce con l’obiettivo di offrire un ambiente end-to-end per l’“agentic computing”, in cui agenti autonomi collaborano tra loro per eseguire processi complessi e multi-step. Integra strumenti già apprezzati dagli sviluppatori su Vertex AI (come selezione, creazione e tuning dei modelli), con nuove funzionalità dedicate alla gestione operativa degli agenti, inclusi DevOps, sicurezza, integrazione e orchestrazione.

Uno degli elementi chiave è l’ampia disponibilità di modelli: ce ne sono oltre 200, tra cui Gemini 3.1 Pro, Nano Banana 2, i modelli open Gemma e anche soluzioni di terze parti come Anthropic con Opus 4.7. Questo approccio multi-modello consente alle aziende di scegliere di volta in volta la soluzione più adatta alle proprie esigenze, mantenendo però un controllo centralizzato attraverso la piattaforma.

Dal punto di vista operativo, Agent Platform consente agli sviluppatori di progettare l’intero ciclo di vita degli agenti, dalla costruzione iniziale fino alla scalabilità e alla governance. Strumenti come l’Agent Development Kit e il supporto MCP permettono di strutturare gli agenti in sottoreti, migliorandone le capacità di ragionamento e la gestione di task complessi. Funzionalità come Memory Bank e runtime ottimizzati favoriscono inoltre una maggiore efficienza operativa e una collaborazione più fluida tra agenti, che possono delegarsi compiti e condividere contesto in modo più efficace.

Un altro aspetto centrale è la sicurezza. Ogni agente può essere infatti dotato di una identità crittografica tramite il sistema Agent Identity, mentre strumenti come Agent Simulation consentono di testare i comportamenti degli agenti in scenari realistici prima del deployment. Questo approccio mira a ridurre i rischi associati all’uso di agenti autonomi, soprattutto in contesti aziendali dove la protezione dei dati è critica.

Una volta completato lo sviluppo, gli agenti possono essere pubblicati nell’app Gemini Enterprise, dove anche utenti non tecnici possono utilizzarli o crearne di nuovi tramite strumenti no-code o low-code come Agent Studio e Agent Designer. Questo amplia significativamente l’accesso alla tecnologia, permettendo a diverse funzioni aziendali di sfruttare gli agenti senza competenze avanzate di programmazione.

Durante la dimostrazione, Google ha mostrato come più agenti possano lavorare simultaneamente su un progetto, ad esempio nella gestione di inventario o campagne marketing, operando come un team coordinato. Gli agenti possono accedere ai dati aziendali tramite integrazione con gli strumenti Workspace, migliorando la qualità delle decisioni e delle strategie.

La piattaforma introduce anche un modello unificato di governance e controllo. Grazie a un “control plane” centralizzato, le aziende possono monitorare, gestire e auditare tutte le attività degli agenti, garantendo visibilità completa al reparto IT. Le policy di sicurezza e i permessi sono semplificati ma rigorosi, con un livello di tracciabilità paragonabile a quello delle applicazioni aziendali critiche come sistemi finanziari o di payroll.

Il lavoro si fa intelligente

Spazio infine a Workspace Intelligence, che Google ha introdotto come evoluzione del lavoro digitale per superare la frammentazione delle informazioni. Nella quotidianità professionale, infatti, gran parte del tempo viene spesa nel passare da un’app all’altra (email, documenti, chat) per raccogliere dati prima ancora di poter agire. L’obiettivo di Workspace Intelligence è ribaltare questo paradigma, trasformando gli strumenti da semplici contenitori a sistemi capaci di comprendere obiettivi, contesto e priorità.

Al centro di questa visione c’è l’integrazione con Google Workspace e l’utilizzo dell’AI di Gemini, che consente di creare un sistema unificato e dinamico. Workspace Intelligence non si limita a collegare applicazioni e aggregare dati, ma interpreta le relazioni semantiche tra documenti, progetti, collaboratori e conoscenze aziendali. Questo permette di fornire un supporto attivo e contestuale adattato alle esigenze specifiche di ogni utente.

Il sistema si basa su tre capacità fondamentali:

- Raccolta intelligente delle informazioni: l’AI individua e recupera automaticamente i contenuti rilevanti, eliminando la necessità di ricerche manuali

- Consapevolezza situazionale: Gemini comprende quali attività siano prioritarie in un determinato momento

- Personalizzazione: analizzando lo storico di lavoro e comunicazione, il sistema adatta tono, stile e formato degli output alle preferenze individuali

Queste funzionalità trovano applicazione concreta in diversi strumenti. In Google Chat, ad esempio, “Chiedi a Gemini” diventa una sorta di riga di comando universale, con la quale basta indicare un obiettivo e l’AI coordina le operazioni necessarie, dalla sintesi delle attività alla creazione di documenti o alla pianificazione di riunioni. Inoltre, grazie all’integrazione con piattaforme esterne come Asana, Jira e Salesforce, è possibile operare su tutto lo stack aziendale senza uscire dalla conversazione.

Anche la creazione di contenuti viene profondamente trasformata. In Documenti, Fogli e Presentazioni, Workspace Intelligence è in grado di generare bozze complete partendo da email, chat e file esistenti, rispettando template e linee guida aziendali. In Fogli, l’uso del linguaggio naturale consente di costruire analisi complesse, mentre in Documenti l’AI può integrare infografiche e gestire feedback nei commenti. In Presentazioni, invece, è possibile ottenere slide pronte all’uso, coerenti con lo stile aziendale.

Sul fronte della gestione delle informazioni, Gmail e Drive diventano strumenti proattivi. L’AI evidenzia le priorità nella posta in arrivo, sintetizza thread complessi e facilita la ricerca, mentre Drive evolve da archivio passivo a base di conoscenza attiva, con nuove modalità di organizzazione come i “Drive Project”.

Infine, per quanto riguarda sicurezza e governance, Workspace Intelligence eredita l’infrastruttura sicura di Google Workspace, garantendo controllo sui dati, crittografia avanzata e conformità normativa. I dati restano sotto il controllo dell’azienda e non vengono utilizzati per addestrare modelli senza consenso.