Perché Bard, il chatbot di Google, avrà impatti enormi su tutto il web

Come prevedibile e previsto, con un post del CEO Sundar Pichai sul blog aziendale, Google ha annunciato che introdurrà nel suo motore di ricerca un chatbot alimentato da un modello di intelligenza artificiale simile a ChatGPT. La notizia arriva nella stessa giornata in cui cominciano a circolare anche schermate di una possibile integrazione tra ChatGPT e il motore di ricerca Bing di Microsoft.

Il recente clamore attorno a ChatGPT e alla sua capacità di produrre autonomamente testi di varia natura in risposta a istruzioni o domande dell’utente non poteva non generare una risposta da parte dell’azienda che ha costruito un impero digitale partendo dalla mission di “organizzare l’informazione globale e renderla universalmente accessibile e utile”.

Il fatto che la risposta fosse prevista non significa però che sia scontata, così come non sono affatto scontate le conseguenze che questo potrà avere sull’intero ecosistema Google, che partendo dai creatori di contenuti e passando per network pubblicitari, agenzie e strumenti, oggi fa di Google la più grande azienda media company globale.

In effetti, da più di due anni Google dispone di una tecnologia simile a ChatGPT. Stiamo parlando del modello linguistico LaMDA (Language Model for Dialogue Applications), annunciato a maggio del 2021 e passato un anno dopo agli onori delle cronache perché Blake Lemoine, un ricercatore Google e membro del Google Responsible AI Project, aveva dichiarato in pubblico di essere convinto che LaMDA era diventato un essere senziente. Lemoine era stato poi licenziato da Google in seguito a questa vicenda.

Proprio su LaMDA sarà basato Bard, che potrà inoltre trarre vantaggio da una integrazione con la base dati di Google e con le altre funzionalità di ricerca. “Bard intende combinare la vastità della conoscenza mondiale con la potenza, l’intelligenza e la creatività del nostro modello linguistico ampio. Acquisisce informazioni dal web per fornire risposte aggiornate e di alta qualità”, afferma Pichai.

Perché allora Google ha tenuto nel cassetto una tecnologia così rivoluzionaria per rilasciarla solo ora?

Perché allora Google ha tenuto nel cassetto una tecnologia così rivoluzionaria per rilasciarla solo ora, quasi costretta dalla concorrenza?

Primo, non toccare qualcosa che funziona

Come dicevamo, sulla funzione di ricerca Google ha costruito un impero della pubblicità che alimenta un ecosistema eterogeneo di soggetti e soluzioni: editori, blogger, siti di ecommerce, agenzie di marketing, consulenti SEO e SEM, piattaforme tecnologiche e aziende di ogni settore ogni secondo sono coinvolte in un mercato che comprende spazi pubblicitari, dati degli utenti, messaggi e offerte. Tutto attorno a un unico obiettivo: conquistare un clic degli utenti in base all’interesse espresso nelle ricerche e nella navigazione su internet.

Non è un caso che Google sia estremamente attenta nel toccare anche solo il minimo dettaglio della sua pagina di ricerca, che ancora oggi è estremamente simile a come appariva nel 1999. La pagina seguente, quella dei risultati della ricerca, è quella dove quotidianamente si combatte la battaglia per l’attenzione degli utenti, cercando di scalare la classifica dei risultati organici o comprando all’asta uno degli spazi disponibili per i risultati sponsorizzati.

La home page di Google è stata modificata pochissimo negli ultimi 24 anni

Fuori dalle pagine di Google, ma comunque inseriti in questo meccanismo, ci sono i siti che creano contenuti di qualità per scalare questa classifica, attirando gli utenti della ricerca su pagine che a loro volta mostrano altra pubblicità, sia essa del network di Google oppure no.

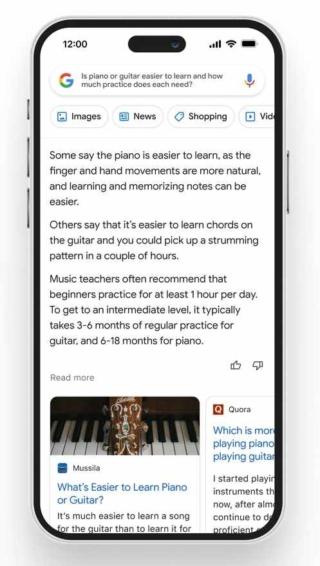

Come appariranno le risposte generate dalla IA di Bard nei risultati di ricerca.

- Se la risposta alla ricerca non sono pagine esterne o link pubblicitari, ma un testo esaustivo che fornisce la domanda direttamente sulle pagine di Google, che succederà al resto dell’ecosistema?

- Privati del traffico in arrivo da Google, che per molti rappresenta la maggioranza dei lettori, come si manterranno gli editori?

- Continueranno a rendere il loro contenuti disponibili gratuitamente agli utenti e ai motori di ricerca? E se non lo faranno, di cosa si alimenteranno i motori di ricerca basati su IA?

- Che accadrà al resto della filiera SEO/SEM, che dovrà adattarsi a nuove modalità di lavoro, che non sarà più basato sulla ricerca delle keyword ma su prompt discorsivi ben più complessi da interpretare?

- Se i messaggi pubblicitari fossero inseriti direttamente nella risposta testuale, quali impatti potrà avere sul pubblico generale, che già ora fatica a distinguere un link organico da uno sponsorizzato?

Apparentemente, le risposte generate dalla IA saranno solo un’introduzione sintetica che servirà a introdurre e contestualizzare i soliti risultati e i soliti annunci, che appariranno più in basso. Cionondimeno si tratta di un cambiamento radicale i cui impatti vanno ben al di là dell’aspetto grafico.

Secondo: la questione della verità e gli aspetti etici

Sono tante le domande che imporrebbero a qualsiasi azienda di ponderare seriamente qualsiasi cambiamento fatto a un elemento centrale del proprio core business. C’è però un’ultima domanda che ci porta dal territorio degli affari a quello dell’etica:

- Il pubblico che rivolge domande a Google è in grado di capire che un large language model è una macchina per generare testi, e non per dare risposte veritiere?

È innegabile che i large language model abbiano compiuto un balzo evolutivo i cui risultati stupiscono e disorientano non solo le persone comuni, ma anche gli addetti ai lavori (come il povero Lemoine citato all’inizio). Pensare però che questi modelli facciano sempre affermazioni veritiere, o addirittura convoglino dei significati in modo cosciente, è un errore che può avere conseguenze importanti e ancora impreviste per individui e società.

ChatGPT ha la proprietà di linguaggio di un trentenne, ma la saggezza di un bambino di cinque anni

Nei giorni scorsi mi sono imbattuto in una definizione fulminante: il problema di ChatGPT è che si esprime con la proprietà di linguaggio di un trentenne, ma ha la saggezza di un bambino di cinque anni. Diventa facile quindi prendere per vere affermazioni strampalate solo perché sono scritte in modo corretto.

Il fatto che nella maggior parte dei casi le risposte siano anche valide e veritiere è un’aggravante, perché porta a riporre nei modelli linguistici una fiducia che allo stato attuale non possono meritarsi.

Non a caso Pichai afferma che l’introduzione di Bard avverrà in modo graduale e responsabile, in base ai canoni etici espressi nei suoi AI Principles, e che lavorerà con governi e organizzazioni per sviluppare standard e best practice in modo da rendere sicura e utile la IA.

Se con il suo Bard Google riuscirà a garantire risposte basate su fatti, riuscendo anche a corroborarle con le fonti delle affermazioni, avrà tra le mani uno strumento estremamente potente che va ben al di là di quanto oggi offre Chat GPT.