7 dubbi su Claude Mythos, il modello AI “troppo potente per essere rilasciato”

Indice dell'articolo

Alcune riflessioni ad alta voce sugli annunci di Anthropic su Claude Mythos, il modello “troppo potente per poter essere rilasciato”. Ma prima, un riassunto della notizia.

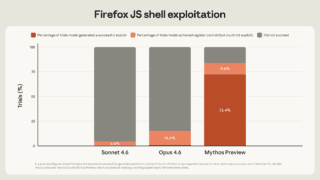

Anthropic ha dichiarato di aver realizzato con Mythos un salto evolutivo e non un semplice aggiornamento del precedente modello di punta Opus, affermando però che non lo rilascerà perché è così potente da avere già individuato migliaia di vulnerabilità in sistemi operativi, browser, software infrastrutturali commerciali e open source.

Potenzialmente, uno strumento che permetterebbe a chiunque – governi, organizzazioni criminali e terroristi ma anche singoli individui – di fare danni a sistemi critici in tutto il mondo. Ha quindi lanciato l’iniziativa Glasswing per rendere disponibile in esclusiva per 90 giorni Mythos Preview a una quarantina di aziende, organizzazioni che operano in settori critici (principalmente banche) e maintainer di progetti open source di importanza critica per permettere loro di correggere le vulnerabilità prima che qualcun altro rilasci un modello altrettanto potente.

Passiamo quindi ad alcune riflessioni e domande che è bene porsi.

1. Anthropic non si fida dei suoi concorrenti?

L’avversione di Amodei verso le AI company cinesi che sfruttano i modelli occidentali per addestrare i propri è nota. Ma il messaggio non troppo velato è che non si fidi nemmeno di OpenAI, xAI e altri suoi colleghi, che potrebbero pubblicare modelli simili senza le sue stesse cautele oppure (lo avranno già fatto?) fornire quella super arma informatica a un solo governo, il loro.

2. Un messaggio trasversale al Pentagono?

Parlando di ciò, l’annuncio suona anche un po’ come uno sberleffo nei confronti del Pentagono, che qualche settimana fa ha cancellato i propri contratti con Anthropic inserendola addirittura in una lista di organizzazioni a rischio per la sicurezza nazionale. Come a dire: “se fossimo rimasti vostri fornitori, avreste potuto avere accesso anticipato o esclusivo a questa arma pazzesca”. E sempre su questo punto, come dovremmo interpellare il fatto che non risulta che siano state coinvolte le istituzioni europee nel progetto? A nostra richiesta su eventuali contatti con Anthropic, ENISA non ha risposto rimandandoci all’ufficio stampa della Commissione, ma prima che potessimo contattarli è arrivata da Politico la notizia che no, non ci sono contatti centralizzati, ma solo con qualche agenzia locale e comunque senza accesso a Mythos Preview al momento.

3. Etica o marketing?

Dimostrare la propria supremazia tecnologica e morale è anche un’enorme opportunità di marketing e un modo per guadagnare tempo quando si ha tra le mani un modello molto potente, ma non l’infrastruttura per erogarlo su larga scala. Quanto avranno contato queste considerazioni nell’annuncio di Glasswing?

4. Che succede ai software di aziende o progetti minori?

Al progetto Glasswing partecipano una manciata di aziende e community open source enormi (da Microsoft, AWS e Cisco alla Linux Foundation e Apache Foundation), ma sono centinaia le componenti software open source mantenute da piccoli gruppi e singoli individui. Componenti che sono essenziali per il funzionamento e la sicurezza dell’infrastruttura internet. Alcuni potranno richiedere accesso a Mythos Preview attraverso il programma Claude for Open Source e la Linux Foundation. Per quelli che ne rimarranno fuori – una volta che usciranno modelli di potenza comparabile – sarà una corsa contro il tempo per correggere le vulnerabilità prima che siano disponibili gli exploit.

5. Rischio escalation accelerata?

APT e cybercriminali che hanno nel cassetto exploit per vulnerabilità 0-day sanno che saranno presto rilasciate delle patch che forse li renderanno inutili. Probabilmente, vorranno quindi sparare subito tutte le cartucce. Il prossimo periodo potrebbe essere “frizzantino” per i CISO.

6. Chi potrà permettersi la sicurezza in questa era?

La corsa non è solo contro il tempo, ma anche con il portafoglio: Anthropic ha stanziato più di 100 milioni di dollari in token per i partecipanti a Glasswing, ma esauriti quelli i costi saranno di 125 dollari per token in uscita, ma soprattutto di 25 dollari per milione di token in ingresso. Considerando che “in ingresso” ci potrebbe stare il codice sorgente di un sistema operativo, i costi non saranno alla portata di tutti.

7. Pensate ancora che l’AI Act sia inutile?

Anthropic ha fatto un’analisi del rischio sistemico del suo nuovo large language model e deciso di attuare delle azioni per mitigarlo prima del rilascio. Per la legge degli Stati Uniti non era obbligata a farlo. Trump ha abrogato la precedente legge di Biden revocando gli obblighi di assessment e trasparenza sui rischi, che rimangono solo per i fornitori del Governo (tra i quali non figura più Anthropic).

La tanto criticata AI Act invece renderà questa pratica obbligatoria in Europa. Con tutte le sue imperfezioni e possibili miglioramenti, probabilmente la legge europea non è poi stata una cattiva idea, no?