Infrastruttura Big Data

Infrastrutture big data: guida a data warehouse, data lake, lakehouse e data mesh

Dai limiti dei database tradizionali alle architetture moderne per la gestione dei dati aziendali: una mappa per orientarsi tra le tecnologie e scegliere la soluzione giusta

Perché i database tradizionali non bastano per i big data

Per decenni, i database relazionali hanno rappresentato la spina dorsale dell’IT aziendale. Strumenti come Oracle Database, Microsoft SQL Server o PostgreSQL sono progettati per gestire dati strutturati — tabelle con righe e colonne, relazioni ben definite, transazioni che richiedono coerenza assoluta. E per queste esigenze continuano a funzionare egregiamente.

Il problema nasce quando i volumi, la velocità e la varietà dei dati superano i confini per cui questi sistemi sono stati concepiti. È il territorio dei big data, tradizionalmente descritto attraverso le cosiddette “3V”: volume (terabyte o petabyte di dati), velocità (flussi continui di dati generati in tempo reale) e varietà (dati strutturati, semi-strutturati e non strutturati come immagini, log, testi liberi, dati IoT).

Un database relazionale tradizionale scala tipicamente in modo verticale: per gestire più dati, si potenzia il singolo server con più CPU, più RAM, più storage. Ma questo approccio ha limiti fisici ed economici evidenti. Le infrastrutture big data, al contrario, scalano in modo orizzontale: distribuiscono il carico su decine, centinaia o migliaia di nodi che lavorano in parallelo. È un cambio di paradigma architetturale, non un semplice aggiornamento hardware.

C’è poi il tema dei dati non strutturati. Un database relazionale vuole schemi rigidi e definiti a priori. Ma oggi una quota crescente delle informazioni aziendali arriva sotto forma di email, documenti, immagini, video, dati da sensori, log applicativi — formati che non si prestano a essere incasellati in tabelle. Servono architetture per la gestione dei dati pensate nativamente per questa eterogeneità.

Architetture per lo storage dei big data: warehouse, lake e lakehouse a confronto

Di fronte ai limiti dei sistemi tradizionali, negli ultimi due decenni sono emerse diverse architetture per lo storage e l’analisi dei big data. Ciascuna risponde a esigenze diverse, e la scelta dipende dal tipo di dati, dai casi d’uso e dalla maturità dell’organizzazione.

Data warehouse: cos’è e quando serve

Un data warehouse è un repository centralizzato di dati strutturati e già elaborati, organizzati per facilitare l’analisi e il reporting. I dati vengono puliti, trasformati e caricati secondo schemi predefiniti — un processo noto come ETL (Extract, Transform, Load). Il risultato è un ambiente ottimizzato per le query analitiche: quando un CFO chiede il fatturato per area geografica dell’ultimo trimestre, è il data warehouse a fornire la risposta in pochi secondi.

Tra le soluzioni di data warehousing più diffuse troviamo Snowflake, Google BigQuery, Amazon Redshift e Azure Synapse Analytics. Il punto di forza è la velocità delle analisi su dati già strutturati. Il limite principale: non gestisce bene dati grezzi o non strutturati, e richiede che qualcuno definisca in anticipo quali dati servono e come organizzarli.

Data lake: archiviazione flessibile per dati eterogenei

Il data lake adotta la filosofia opposta: prima si archiviano i dati in formato grezzo, poi si decide come usarli. Qualsiasi tipo di dato — strutturato, semi-strutturato o non strutturato — viene archiviato così com’è, tipicamente su sistemi di object storage come Amazon S3 o Azure Data Lake Storage. Questo approccio è particolarmente indicato per chi lavora con machine learning o analisi esplorative, dove non si sa in anticipo quali informazioni saranno utili.

Il rischio è noto nel settore: senza una governance adeguata, il data lake può trasformarsi in un data swamp — una palude di dati in cui nessuno riesce più a trovare quello che cerca. Catalogazione, metadati e regole di accesso sono essenziali per evitare questo scenario.

Data lakehouse: l’architettura ibrida tra warehouse e lake

Il data lakehouse è un’architettura relativamente recente che combina la flessibilità del data lake con le capacità analitiche del data warehouse. L’idea è semplice: conservare i dati in formato aperto su object storage (come un data lake), ma aggiungere un layer di gestione che abilita transazioni ACID, schema enforcement e query performanti (come un data warehouse).

Tecnologie come Delta Lake (Databricks), Apache Iceberg e Apache Hudi hanno reso possibile questo approccio. Il vantaggio del data lakehouse è eliminare la necessità di mantenere due sistemi separati — lake e warehouse — riducendo complessità e costi. È l’architettura verso cui si stanno orientando molte organizzazioni, specialmente quelle con esigenze sia di analytics tradizionale sia di data science e intelligenza artificiale.

Tabella comparativa: data warehouse vs data lake vs data lakehouse

| Data warehouse | Data lake | Data lakehouse | |

| Tipo di dati | Strutturati | Tutti i formati | Tutti i formati |

| Schema | Definito a priori | Alla lettura | Flessibile + enforcement |

| Ottimizzato per | BI e reporting | Data science e ML | Analytics + AI |

| Costo storage | Elevato | Contenuto | Contenuto |

| Rischio principale | Rigidità | Data swamp | Complessità iniziale |

Data fabric e data mesh: orchestrare i dati aziendali

Man mano che le organizzazioni accumulano dati in sistemi diversi — data warehouse, data lake, database operazionali, applicazioni SaaS — emerge un problema di orchestrazione: come rendere tutti questi dati accessibili, coerenti e governati? Due approcci cercano di rispondere a questa domanda, ma da prospettive molto diverse.

Data fabric: integrazione automatizzata dei dati distribuiti

Il data fabric è un layer tecnologico che si sovrappone ai sistemi esistenti per collegare, integrare e rendere accessibili i dati ovunque risiedano — on-premise, nel cloud o in ambienti ibridi. Attraverso metadati attivi, automazione e spesso intelligenza artificiale, il data fabric crea una visione unificata del patrimonio informativo aziendale senza dover spostare fisicamente i dati.

Gartner lo ha identificato come una delle tendenze tecnologiche più rilevanti degli ultimi anni. Vendor come IBM, Informatica e Talend offrono piattaforme di data fabric. Il punto di forza è la capacità di integrare fonti eterogenee in modo relativamente trasparente. La sfida è la complessità dell’implementazione e il rischio di un approccio troppo centralizzato.

Data mesh: la gestione decentralizzata dei dati

Il data mesh, concettualizzato da Zhamak Dehghani, non è una tecnologia ma un modello organizzativo. L’idea centrale è che la responsabilità dei dati non debba ricadere su un team centrale di data engineering, ma sui singoli domini di business che quei dati producono e conoscono meglio. Ogni dominio tratta i propri dati come un prodotto, con standard di qualità, documentazione e interfacce di accesso ben definite.

La differenza chiave tra data fabric e data mesh è dunque questa: il data fabric è una soluzione prevalentemente tecnologica, il data mesh è un cambio di paradigma organizzativo. Non sono mutuamente esclusivi — anzi, molte organizzazioni adottano elementi di entrambi, usando tecnologie da data fabric all’interno di un modello ispirato al data mesh.

Elaborazione dei big data: batch processing e stream processing

Archiviare i dati è solo metà del problema. L’altra metà è elaborarli — trasformarli in informazioni utili per il business. Due paradigmi dominano questo spazio.

Il batch processing elabora grandi volumi di dati in blocco, tipicamente con cadenza periodica. È l’approccio classico: si raccolgono i dati durante la giornata e si lanciano job di elaborazione notturni. Apache Hadoop e il suo framework MapReduce sono stati il punto di riferimento per oltre un decennio, oggi affiancati da Apache Spark, che offre prestazioni nettamente superiori grazie all’elaborazione in memoria.

Lo stream processing (o elaborazione in tempo reale) analizza i dati nel momento stesso in cui vengono generati. Quando un sistema antifrode deve valutare una transazione bancaria nell’istante in cui avviene, o quando un impianto industriale deve reagire a un’anomalia segnalata da un sensore IoT, il batch processing non è un’opzione. Tecnologie come Apache Kafka, Apache Flink e Amazon Kinesis abilitano questo tipo di elaborazione continua.

Un concetto collegato è la distinzione tra ETL (Extract, Transform, Load) ed ELT (Extract, Load, Transform). Nel modello ETL tradizionale, i dati vengono trasformati prima di essere caricati nel sistema di destinazione. Nell’approccio ELT, più diffuso con il cloud computing e i data lakehouse, i dati grezzi vengono caricati prima e trasformati dopo, sfruttando la potenza di calcolo del sistema di destinazione. Il modello ELT sta guadagnando terreno perché offre maggiore flessibilità e permette di conservare i dati originali per usi futuri.

Cloud, on-premise o ibrido: dove costruire l’infrastruttura big data

Ogni architettura big data poggia su un’infrastruttura sottostante, e la scelta tra cloud, on-premise e modelli ibridi è una delle decisioni più impattanti. Il cloud pubblico (AWS, Azure, Google Cloud) offre scalabilità e accesso immediato a servizi gestiti, ma i costi possono crescere rapidamente con i volumi e il rischio di vendor lock-in è concreto. L’on-premise resta la scelta di chi ha requisiti stringenti di sicurezza e compliance, ma richiede investimenti iniziali significativi. Nella pratica, la maggior parte delle organizzazioni medio-grandi adotta un approccio ibrido o multi-cloud.

Un elemento fondamentale da menzionare è l’object storage (Amazon S3, Azure Blob Storage, MinIO per l’on-premise), su cui si fondano praticamente tutti i data lake e lakehouse moderni. A differenza dei file system tradizionali, l’object storage gestisce i dati come oggetti indipendenti con metadati associati, ed è ideale per gestire enormi volumi di dati eterogenei a costi contenuti.

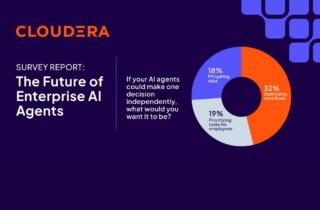

Big data e intelligenza artificiale: perché l’infrastruttura dati è la base dell’AI

Un ultimo elemento lega tutti i temi affrontati fin qui: l’intelligenza artificiale. I modelli di machine learning e AI generativa hanno bisogno di enormi quantità di dati per essere addestrati e di infrastrutture performanti per funzionare in produzione. Non è un caso che le organizzazioni più avanzate nell’adozione dell’AI siano anche quelle che hanno investito prima e meglio nelle proprie infrastrutture big data.

Investire oggi in un’infrastruttura big data solida — che si tratti di un data lakehouse, di un approccio data mesh o di una piattaforma cloud ben governata — non è solo una questione di efficienza operativa. È la precondizione per poter sfruttare l’intelligenza artificiale domani. E in un mercato in cui l’AI sta rapidamente passando dall’essere un vantaggio competitivo a un requisito di base, ritardare questa scelta potrebbe rivelarsi più costoso che affrontarla.