Microsoft Database Hub fornisce gestione unificata e AI per governare ecosistemi dati sempre più complessi

La crescente frammentazione degli ambienti dati rappresenta oggi una delle principali criticità per le organizzazioni moderne. Tra infrastrutture on-premises, servizi PaaS e piattaforme SaaS, la gestione dei database si è trasformata in un mosaico eterogeneo, spesso governato da strumenti separati e logiche operative non uniformi. Microsoft si inserisce in questo scenario con Database Hub, che punta a ridefinire il modo in cui le aziende controllano e orchestrano il proprio patrimonio informativo.

Integrato all’interno della piattaforma Microsoft Fabric, Database Hub nasce come punto di convergenza per la gestione di molteplici servizi database, offrendo un’interfaccia unificata capace di coprire sia sistemi relazionali, sia NoSQL. Tra le tecnologie supportate figurano Azure SQL Server, Azure Cosmos DB, Azure Database for PostgreSQL e Azure Database for MySQL, oltre a istanze di SQL Server abilitate tramite Azure Arc. Il risultato è un layer di controllo trasversale che mira a superare la tradizionale separazione tra ambienti e modelli di deployment.

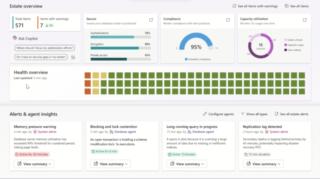

L’idea di fondo è semplice nella formulazione ma complessa nell’implementazione, ovvero offrire una “single pane of glass” attraverso cui ingegneri e team IT possano monitorare, configurare e ottimizzare l’intero ecosistema dati. Secondo Shireesh Thota, vicepresidente corporate Microsoft per i database, l’obiettivo è accompagnare le organizzazioni in un percorso di modernizzazione che unifichi il data estate e acceleri lo sviluppo di applicazioni native per l’IA.

Il valore di un approccio centralizzato emerge soprattutto in contesti ibridi e distribuiti, dove la coesistenza di database relazionali e non relazionali genera complessità operative difficili da gestire con strumenti tradizionali. Database Hub interviene proprio su questo punto critico, cercando di eliminare la frammentazione degli strumenti e di offrire una visione coerente dello stato dei sistemi.

Uno degli elementi più distintivi della piattaforma è l’integrazione di funzionalità basate su IA. Microsoft introduce un modello definito “agent-assisted, human-in-the-loop”, in cui agenti intelligenti analizzano continuamente segnali provenienti dall’intero ecosistema database. Questi agenti non si limitano a segnalare anomalie, ma cercano di interpretarle, fornendo indicazioni sul loro impatto e suggerendo possibili azioni correttive. È un approccio che sposta il focus dalla semplice osservabilità alla capacità di supportare decisioni operative.

In questo contesto, entra in gioco anche Microsoft Copilot, che estende le proprie capacità al dominio della gestione dati. Copilot è progettato per offrire insight contestualizzati, facilitando la comprensione di dinamiche complesse come variazioni di performance, colli di bottiglia o anomalie nei carichi di lavoro. L’intervento di Copilot punta a ridurre il tempo necessario per passare dall’analisi all’azione, migliorando al contempo l’affidabilità delle decisioni.

Resta tuttavia aperta una questione cruciale, rappresentata dal livello di fiducia che i team tecnici saranno disposti a concedere a sistemi di AI in un ambito delicato come la gestione dei database. L’ottimizzazione di queste piattaforme implica infatti una serie di scelte complesse, che spaziano dalla configurazione dei parametri runtime alla gestione della memoria, fino alla progettazione fisica dei dati e all’ottimizzazione delle query. Si tratta di un dominio in cui l’esperienza umana e la conoscenza del contesto applicativo giocano un ruolo determinante.

Negli ultimi anni, la ricerca accademica ha iniziato a esplorare il potenziale dell’IA anche in questo ambito. Studi condotti dal Carnegie Mellon University Database Group hanno dimostrato come algoritmi basati su embedding vettoriali possano migliorare significativamente le configurazioni di default di database come PostgreSQL, con incrementi di performance rilevanti e tempi di ottimizzazione drasticamente ridotti grazie all’uso di modelli linguistici avanzati.

Microsoft sembra voler capitalizzare su queste evoluzioni, integrando capacità simili all’interno di un framework operativo più ampio. Non è però ancora chiaro fino a che punto Database Hub sarà in grado di intervenire direttamente su attività di tuning avanzato o se si limiterà a fornire raccomandazioni.

Oltre a Microsoft, anche player come Snowflake e Databricks stanno progressivamente integrando funzionalità transazionali all’interno delle proprie piattaforme, con l’obiettivo di unificare analytics, machine learning e gestione operativa dei dati sotto un unico modello di governance. Anche in questo caso, il tema centrale è ridurre la distanza tra sistemi diversi per semplificare sviluppo e gestione.

Microsoft, dal canto suo, ha già dimostrato un interesse crescente verso ecosistemi database eterogenei andando oltre il proprio SQL Server. L’introduzione di servizi basati su PostgreSQL e lo sviluppo di estensioni open source indicano proprio una strategia orientata all’interoperabilità e alla flessibilità.

(Immagine in apertura: Shutterstock)