Mistral Workflows offre orchestrazione AI enterprise con governance dei dati. Prima alternativa EU a Bedrock, Azure AI Studio e Vertex

Si chiama Workflows ed è il nuovo layer di orchestrazione annunciato da Mistral AI attualmente disponibile in public preview. La nuova soluzione della startup AI francese affronta un problema strutturale che molte organizzazioni stanno sperimentando, ovvero trasformare prototipi AI funzionanti in pipeline robuste, monitorabili e governabili su scala.

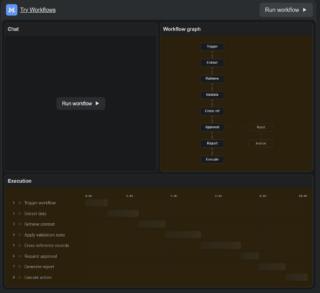

Workflows si integra all’interno della piattaforma Studio e introduce un approccio dichiaratamente ingegneristico alla gestione dei processi AI multi-step. L’idea di fondo è consentire agli sviluppatori di costruire flussi complessi combinando modelli, agenti e connettori esterni, mantenendo al tempo stesso controllo su esecuzione, stato e recovery. La definizione dei workflow avviene in Python, una scelta che privilegia flessibilità e accessibilità per i team tecnici, evitando linguaggi proprietari o DSL troppo rigidi.

Il punto di forza della piattaforma è nella gestione dello stato. A differenza di molte pipeline AI tradizionali, che operano in modalità stateless e quindi fragile rispetto a interruzioni o errori, Workflows introduce un’esecuzione stateful. Questo significa che un processo può essere interrotto e ripreso esattamente dal punto di failure, senza necessità di restart completi o workaround applicativi. In ambienti enterprise, dove i flussi possono durare minuti o ore e coinvolgere sistemi eterogenei, questa capacità rappresenta un salto qualitativo significativo.

Dal punto di vista architetturale, la soluzione si basa su Temporal, un framework già affermato nel mondo dell’orchestrazione distribuita. Mistral ne estende le funzionalità introducendo elementi specifici per l’AI, come la gestione di payload complessi, lo streaming dei risultati e strumenti avanzati di osservabilità. La separazione tra control plane e data plane è un altro elemento chiave grazie al quale, mentre l’orchestrazione viene gestita su infrastruttura Mistral, l’esecuzione dei worker e il trattamento dei dati restano sotto il controllo del cliente, sia in cloud sia on-premise o in configurazioni ibride. Un approccio che risponde direttamente alle esigenze di compliance e sovranità dei dati, sempre più centrali nei contesti regolati.

Considerando che uno dei limiti più evidenti delle implementazioni AI attuali è la difficoltà nel gestire eccezioni e condizioni intermedie, Workflows introduce meccanismi nativi come retry policy, rate limiting e tracing integrato, riducendo la necessità di logica custom. Tuttavia, l’elemento più distintivo è il supporto esplicito per scenari human-in-the-loop. Gli sviluppatori possono inserire checkpoint di approvazione all’interno dei flussi, permettendo ai processi di sospendersi senza consumare risorse computazionali e riprendere solo dopo un intervento umano. Questo modello è particolarmente rilevante per settori come finanza, sanità e pubblica amministrazione, dove la tracciabilità delle decisioni e la supervisione manuale sono requisiti imprescindibili.

L’integrazione con Le Chat consente inoltre di attivare e monitorare i workflow a livello organizzativo, trasformando l’orchestrazione in un servizio accessibile anche oltre i team di sviluppo. In parallelo, Studio funge da interfaccia di osservabilità e auditing, offrendo visibilità completa sull’esecuzione, sugli errori e sulle performance dei processi. Questo doppio livello (operativo e gestionale) riflette una maturazione della piattaforma verso use case enterprise reali, dove governance e controllo sono tanto importanti quanto le prestazioni.

Nonostante l’impianto tecnico solido, le prime reazioni della community evidenziano criticità tutt’altro che marginali. Il tema dell’affidabilità dei modelli resta aperto, visto che orchestrare agenti e pipeline non risolve automaticamente problemi legati alla variabilità delle risposte o all’efficienza nell’uso delle risorse, in particolare GPU. Come osservato da alcuni sviluppatori, il rischio è che la complessità venga semplicemente spostata a un livello inferiore, senza essere realmente eliminata.

Un altro punto critico riguarda la gestione degli output “ambigui”, una condizione tipica dei sistemi AI. In contesti enterprise, il problema è stabilire cosa accade quando un risultato è parzialmente corretto o non deterministico. Servono meccanismi di rollback, responsabilità chiare e audit trail completi. È proprio in questa zona grigia che molti progetti di automazione AI tendono a fallire, incapaci di tradurre l’intelligenza generativa in processi affidabili e verificabili.

In tal senso, Workflows rappresenta un tentativo concreto di colmare il gap tra sperimentazione e produzione. L’obiettivo è ridurre il tempo necessario per portare un caso d’uso AI in esercizio, standardizzando componenti che oggi vengono spesso sviluppati ad hoc. La disponibilità tramite SDK Python, installabile con un singolo comando, abbassa ulteriormente la barriera d’ingresso, favorendo una rapida adozione almeno nelle fasi iniziali.

Resta da capire quanto questo modello riuscirà a scalare in ambienti complessi, dove le integrazioni legacy, le policy di sicurezza e i requisiti normativi introducono livelli di frizione difficili da astrarre. La direzione è comunque chiara e vede l’orchestrazione sempre più come un nuovo layer critico dell’AI enterprise, quasi una sorta di sistema operativo per agenti e modelli. In questo scenario, la proposta di Mistral si inserisce come una delle prime implementazioni strutturate, con l’ambizione di trasformare l’AI da insieme di tool a infrastruttura operativa coerente.