Ecco DeepSeek V4, il modello cinese open-weight da 1.000 miliardi di parametri

Con il rilascio della versione preview del suo nuovo LLM di punta V4, la startup AI cinese DeepSeek torna al centro del dibattito sull’evoluzione dei modelli linguistici, spostando ancora una volta l’attenzione su prestazioni elevate abbinate a un controllo aggressivo dei costi. Il contesto, però, è profondamente diverso rispetto al debutto del modello R1, che aveva colto di sorpresa il mercato globale. Oggi infatti la competitività dell’ecosistema cinese è una variabile già incorporata nelle strategie industriali e nelle valutazioni finanziarie.

V4 si inserisce in questa traiettoria come un aggiornamento meno dirompente sul piano simbolico, ma più rilevante sotto il profilo tecnico-operativo. Il modello è distribuito in modalità open source, confermando una scelta che distingue DeepSeek da molti competitor occidentali. La possibilità di scaricare, eseguire in locale e modificare il codice rappresenta un fattore chiave per l’adozione da parte di sviluppatori e aziende, soprattutto in contesti in cui la sovranità dei dati e il controllo dell’infrastruttura sono prioritari.

Dal punto di vista architetturale, V4 è proposto in due varianti (Pro e Flash) e punta a offrire prestazioni competitive in ambiti specifici come i task agentici, l’elaborazione della conoscenza e l’inferenza. È proprio su quest’ultimo punto che si concentra gran parte del valore strategico del modello; ridurre il costo dell’inferenza significa infatti abbattere la barriera economica all’uso su larga scala, trasformando l’AI da risorsa costosa a componente operativa quotidiana.

Rivolta ai compiti più complessi, DeepSeek-V4-Pro è la versione più potente della nuova famiglia (1.600 miliardi di parametri complessivi e 49 miliardi di parametri attivi per ogni token elaborato). DeepSeek-V4-Flash, adatta quando servono molte richieste, tempi di risposta più rapidi e costi inferiori, è la variante più leggera, con 284 miliardi di parametri totali e 13 miliardi attivi. La finestra di contesto di 1 milione di token resta però identica per entrambe le versioni. Per quanto riguarda i prezzi API, nel caso di Flash gli input partono da 0,028 dollari, mentre l’output costa 0,28 dollari. Per la versione Pro, gli input partono da 0,145 dollari e l’output costa 3,48 dollari.

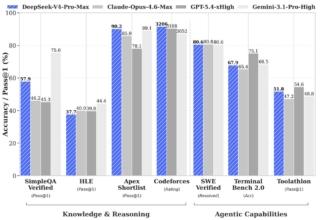

Secondo i benchmark interni di DeepSeek, V4-Pro risulta essere il modello open source più potente in materia di programmazione e matematica, con prestazioni che, per quanto riguarda la conoscenza del mondo, sono seconde solo a quelle di Gemini 3.1-Pro di Google, un modello closed-source.

V4 arriva in un mercato che sta progressivamente spostando l’attenzione dal training, che resta oneroso ma episodico, all’inferenza, che rappresenta il costo ricorrente per qualsiasi applicazione reale. In questo senso, il nuovo modello sembra posizionarsi come una piattaforma efficiente, capace di offrire un buon equilibrio tra qualità dell’output e consumo di risorse computazionali. Un altro elemento distintivo riguarda l’integrazione con strumenti agentici, visto che V4 è stato ottimizzato per lavorare con ambienti come Claude Code e OpenClaw,

Per comprendere il significato di questo novo modello, è utile tornare al punto di svolta rappresentato da R1. Quando DeepSeek introdusse quel modello, dimostrò che era possibile raggiungere livelli di performance comparabili ai leader di mercato con risorse significativamente inferiori. Il dato più citato (meno di 6 milioni di dollari e tempi di sviluppo ridotti) mise in discussione l’assunto secondo cui il progresso nell’AI richiede investimenti sempre più massicci in hardware e infrastrutture. In quel momento, aziende come OpenAI e Google si trovarono implicitamente sotto pressione, almeno sul piano narrativo.

Dopo il boom di R1, il mercato ha accettato l’idea che modelli competitivi (per lo più cinesi) possano essere sviluppati al di fuori dei grandi player statunitensi e con un’efficienza superiore. Non a caso giganti tech come Alibaba e ByteDance stanno accelerando lo sviluppo di modelli proprietari, contribuendo a un ecosistema altamente dinamico. Il risultato è una pressione competitiva che si riflette anche sui mercati finanziari, con oscillazioni significative nei titoli delle aziende coinvolte nella filiera AI.

Un nodo particolarmente rilevante riguarda l’infrastruttura hardware, ovvero quali chip siano stati utilizzati per addestrare V4. Le restrizioni statunitensi sull’export di semiconduttori avanzati hanno limitato l’accesso diretto ai prodotti più recenti di Nvidia, costringendo le aziende cinesi a sviluppare alternative domestiche o a ottimizzare l’uso di hardware meno performante.

Qui si inserisce Huawei, che ha dichiarato la compatibilità del proprio cluster AI basato su processori Ascend con il modello V4. Anche se non è chiaro quanto questi chip abbiano inciso nella fase di training, la possibilità di eseguire il modello su hardware locale rappresenta un passaggio strategico significativo verso l’autonomia tecnologica.

Le implicazioni si estendono anche alla supply chain. Dopo l’annuncio di V4, produttori cinesi di semiconduttori come SMIC e Hua Hong Semiconductor hanno registrato rialzi significativi, segno che il mercato interpreta questi sviluppi come un’opportunità per l’industria domestica.

(Immagine in apertura: Shutterstock)