Ecco Gemma 4, il modello open-source più potente di Google, gratis anche per uso commerciale

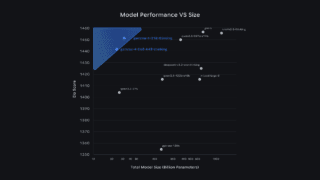

Con Gemma 4, Google vuole ridefinire cosa significa “modello open” nel panorama dell’intelligenza artificiale nel 2026. La nuova famiglia di modelli IA porta infatti su hardware accessibile (da uno smartphone Android a una workstation con GPU consumer) capacità di ragionamento che fino a pochi mesi fa erano prerogativa esclusiva dei grandi modelli proprietari. Il dato che sintetizza meglio questa ambizione è il posizionamento del modello da 31 miliardi di parametri al terzo posto assoluto tra i modelli open sulla classifica Arena AI, superando soluzioni con una densità di parametri venti volte superiore.

Da quando Google ha rilasciato la prima generazione di Gemma, la piattaforma ha totalizzato oltre 400 milioni di download e generato un ecosistema di più di 100.000 varianti sviluppate dalla community (il cosiddetto Gemmaverse). Gemma 4 non nasce quindi in un vuoto, ma risponde a un feedback preciso proveniente da migliaia di sviluppatori, ricercatori e aziende che hanno già integrato i modelli precedenti nei propri prodotti.

Quattro varianti, un’unica architettura

La famiglia Gemma 4 si articola in quattro configurazioni progettate per scenari d’uso radicalmente diversi. Le varianti E2B ed E4B (la “E” indica un footprint effettivo di 2 e 4 miliardi di parametri durante l’inferenza) sono ottimizzate per dispositivi edge come smartphone, Raspberry Pi e moduli IoT. Funzionano completamente offline, con latenza quasi nulla, e integrano nativamente input audio per il riconoscimento vocale. Le due varianti maggiori (26B Mixture of Experts e 31B Dense) operano su GPU consumer quantizzate o su singole unità H100 in configurazione non compressa e sono orientate rispettivamente alla velocità di inferenza e alla qualità grezza dell’output.

L’architettura MoE del modello da 26 miliardi è particolarmente significativa; durante l’inferenza vengono infatti attivati soltanto 3,8 miliardi di parametri, il che si traduce in token-per-secondo nettamente più elevati rispetto a un modello denso equivalente. Per chi costruisce agenti o pipeline con requisiti di latenza stringenti, questa caratteristica rappresenta un vantaggio operativo diretto.

Ragionamento e codice

Le capacità di Gemma 4 che più interessano gli sviluppatori professionali vanno oltre la generazione di testo. Il supporto nativo al function calling, all’output JSON strutturato e alle istruzioni di sistema consente di costruire agenti autonomi capaci di interagire con API esterne, orchestrare workflow e gestire strumenti multipli in sequenza, senza che il modello debba essere addestrato ad hoc per queste funzioni. La generazione di codice è inoltre trattata come caso d’uso primario, con la possibilità di utilizzare i modelli localmente come assistente integrato nell’IDE e completamente disconnesso dalla rete.

Sul fronte multimodale, tutti e quattro i modelli processano immagini e video nativamente, con supporto a risoluzioni variabili e prestazioni dichiarate eccellenti su task come OCR e interpretazione di grafici. Le varianti edge aggiungono l’elaborazione audio, aprendo scenari applicativi che spaziano dall’accessibilità alle interfacce vocali offline. La finestra di contesto raggiunge i 128K token per i modelli E2B/E4B e i 256K per le varianti maggiori, numeri sufficienti a ingerire repository di codice completi o documenti lunghi in un singolo prompt.

La scelta della licenza Apache 2.0

Su questo punto Google ha fatto una scelta netta, dopo le perplessità sollevate dalla community riguardo alle restrizioni delle licenze precedenti. Apache 2.0 è una licenza commercialmente permissiva nel senso più pieno, visto che consente di usare, modificare, distribuire e integrare i modelli in prodotti commerciali senza vincoli di sublicenza, garantendo al contempo sovranità digitale completa su dati e infrastruttura.

Per aziende che operano in settori regolamentati o che per ragioni legali o di sicurezza non possono inviare dati a servizi cloud esterni, questa combinazione di capacità e libertà licenziale apre possibilità concrete. INSAIT ha già costruito su Gemma il primo modello linguistico bulgaro di riferimento (BgGPT), mentre la Yale University ha utilizzato il nuovo modello nel progetto Cell2Sentence-Scale per identificare nuovi percorsi terapeutici in oncologia. Sono esempi che indicano come Gemma 4 non sia pensato solo per il prototipo veloce, ma anche per diventare il motore di applicazioni verticali con requisiti tecnici e normativi esigenti.