Costo dell’inferenza AI: perché il -90% previsto da Gartner non alleggerirà i budget enterprise

Secondo le previsioni pubblicate da Gartner nei giorni scorsi, entro la fine del decennio eseguire inferenza AI su un LLM da un trilione di parametri costerà ai fornitori di GenAI oltre il 90% in meno rispetto ai livelli attuali. Un dato che, a prima lettura, sembrerebbe aprire la strada a una democratizzazione dell’intelligenza artificiale avanzata su scala enterprise. La realtà che emerge dall’analisi è però strutturalmente diversa e chi si occupa di pianificazione tecnologica farebbe bene a non fermarsi alla cifra appena citata.

La riduzione dei costi sarà alimentata da una combinazione di fattori convergenti:

- Miglioramenti nell’efficienza dei semiconduttori

- Innovazioni nella progettazione dei modelli

- Diffusione di chip specializzati per l’inferenza

- Crescente adozione di dispositivi edge per casi d’uso specifici

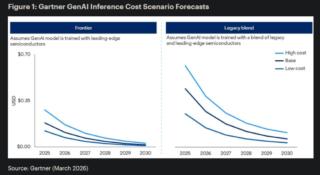

Gartner stima che gli LLM del 2030 saranno fino a cento volte più efficienti dal punto di vista dei costi rispetto ai primi modelli di dimensioni analoghe sviluppati nel 2022. Le proiezioni sono articolate su uno scenario “frontier”, basato sui chip più avanzati disponibili, e uno “legacy blend”, che riflette il mix realistico di semiconduttori in circolazione sul mercato, con costi modellati significativamente più alti nel secondo caso.

Il paradosso dell’efficienza

La dinamica che si profila è quella che in economia è definita “effetto rebound”: i risparmi unitari generano un’espansione della domanda tale da annullare o invertire il beneficio complessivo. I token, unità di misura con cui i modelli GenAI elaborano i dati, diventeranno sì più economici, ma la quantità di token consumata crescerà a un ritmo superiore alla velocità con cui il loro costo scende. Il risultato netto, per molte organizzazioni, sarà una spesa AI complessivamente più alta, non più bassa.

Il motore principale di questa dinamica sono i modelli agentici. A differenza di un chatbot conversazionale standard, un agente AI che pianifica, ragiona, chiama strumenti esterni e itera su più passaggi può consumare tra cinque e trenta volte più token per completare un singolo task. Moltiplicando questo consumo per il volume di processi aziendali che le organizzazioni intendono automatizzare, l’intelligenza di frontiera non si avvicina economicamente, ma si allontana proporzionalmente alla sua utilità.

Cosa cambia per l’architettura AI enterprise

Will Sommer, Senior Director Analyst di Gartner, ha sintetizzato il rischio con una formula diretta: “chi oggi maschera inefficienze architetturali con token economici, troverà l’agentic scale inaccessibile domani”. Il monito è rivolto in particolare ai Chief Product Officer, ma vale per chiunque abbia responsabilità sulla progettazione dello stack AI aziendale.

Il valore, secondo Gartner, si concentrerà sulle piattaforme capaci di orchestrare carichi di lavoro distribuiti su un portfolio eterogeneo di modelli. Questo significa introdurre un livello di routing intelligente che assegni a ogni task il modello più appropriato in base al suo profilo di complessità e valore. I task ad alta frequenza e bassa complessità devono quindi essere gestiti da small language model o domain-specific model, che in contesti specializzati superano le soluzioni generaliste a una frazione del costo. I modelli di frontiera vanno invece riservati esclusivamente ai task che richiedono ragionamento complesso e generano margine sufficiente a giustificare il costo computazionale.

Il punto cruciale che emerge dall’analisi Gartner è che mentre le funzionalità di base tenderanno verso un costo marginale prossimo allo zero e verranno progressivamente incorporate negli ecosistemi esistenti come utilità infrastrutturali, la computazione necessaria per supportare reasoning complesso rimane scarsa e costosa.

Per i team responsabili della governance AI, questo ha implicazioni operative concrete. Le organizzazioni che riusciranno a tracciare con precisione dove e perché vengono consumati token di frontiera potranno identificare chiamate ridondanti, step agentici non necessari e interazioni a basso valore che silenziosamente erodono il budget. Chi invece tratterà i token economici come una licenza all’inefficienza, si troverà a gestire un’economia unitaria insostenibile proprio nel momento in cui l’adozione su scala diventerà un requisito competitivo.

(Immagine in apertura: Shutterstock)