La super-AI potrà eseguire il 98% delle azioni che Messi fa in campo, ma il suo genio è nel 2% restante

Indice dell'articolo

- Superintelligenza: né robot fantascientifici, né sostituto dell’uomo

- Miglioramento continuo o breakthrough?

- I modelli open weight/open source nell’IA di frontiera

- Come potremo valutare un’entità che è più intelligente dei suoi creatori?

- Il funzionamento intuitivo degli LLM e la criticità degli “Evals”

- Il ruolo degli umani e l’esempio di Messi

- Il nuovo ruolo delle aziende e dei loro leader

La superintelligenza, qualsiasi cosa essa sia, è raggiungibile semplicemente rendendo gli attuali modelli linguistici più potenti o ci sono limiti strutturali? Come potremo valutare sistemi che potrebbero essere più intelligenti dei loro esaminatori stessi? Rischiamo che gli LLM ci ingannino sulle loro effettive capacità? Come sta cambiando il ruolo delle persone e delle aziende in un mondo in cui sempre più compiti sono delegati all’IA?

Sono alcune dei temi di cui abbiamo discusso con Rohit Patel, Direttore presso i Meta Superintelligence Labs, recentemente incontrato nel corso della conferenza EmTech Europe ad Atene, dove ha presentato una sessione sulle strategie per la valutazione dei sistemi AI in contesto aziendale.

Temevamo di dover ascoltare quei proclami che spesso i personaggi della Silicon Valley fanno parlando del tema, ma le sue risposte sono molto pragmatiche e orientate ai risultati pratici. Anche se i modelli continuano a sorprendere anche chi li costruisce ogni giorno, il mondo reale è osservabile e le azioni che eseguono lasciano tracce misurabili. Per Patel, che ha lavorato molto sui criteri di valutazione delle IA, quello sarà il metro di misura.

L’intervista è avvenuta poco prima del suo intervento in conferenza, e Patel – che precisa di parlare a titolo personale e non in rappresentanza di Meta – non aveva ancora rivelato i dettagli del suo speech. Il nostro resoconto qui di seguito integra i contenuti di entrambe le discussioni.

Superintelligenza: né robot fantascientifici, né sostituto dell’uomo

DigitalWorld: Lei dirige i Meta Superintelligence Labs, ma ogni persona a cui chiediamo una definizione di superintelligenza sembra avere una risposta diversa. Qual è la sua?

Rohit Patel, Director dei Meta Superintelligence Labs

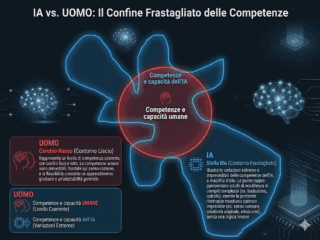

Patel: “Non esiste un consenso nel settore, e penso che ognuno abbia una propria interpretazione di dove stia andando l’AI e dove dovrebbe andare, ma in linea generale non penso che ci sarà un’entità che inglobi e superi tutte le capacità di un essere umano”. Patel usa un diagramma di Venn per spiegarsi: “se immaginiamo di rappresentare le capacità AI e umane come insiemi, potremo rappresentare cose che solo l’AI sa fare (rispondere a domande su un’enorme varietà di argomenti in tempi che nessun umano potrebbe eguagliare), ma ci sono anche attività umane che l’IA non farà mai, come donare un rene volontariamente. Poi c’è un’intersezione tra i due insiemi. L’obiettivo non è che il cerchio dell’AI un giorno contenga completamente quello dell’uomo”.

“Quello che stiamo cercando di fare è avere un compagno affidabile, con un’ampia varietà di capacità, che mi aiuti nella vita, che abbia sia l’ampiezza che la profondità, e che sia superumano in certi aspetti. L’obiettivo è poter scaricare su di esso una parte sempre maggiore del mio carico cognitivo mentale, e concentrarmi su attività sempre più complesse o specificamente umane”.

La scelta del termine compagno (companion) non è casuale. Patel si mantiene distante da ogni narrativa apocalittica o messianica: l’AI è uno strumento che si espande, non un’entità superumana che lo sostituirà.

Miglioramento continuo o breakthrough?

DW: Se questa superintelligenza sarà un miglioramento dei modelli attuali, basterà continuare ad aumentare il numero di parametri e la potenza di calcolo o a un certo punto bisognerà percorrere nuove strade? Ultimamente si parla molto di world model e approccio neuromorfico…

Per introdurre la risposta, Patel fa un parallelo storico: il transistor e la commutazione a pacchetto erano invenzioni semplici, ma combinando e ricombinando tra loro questi nuclei di intelligenza (usa l’espressione kernel), si sono generate l’intera rivoluzione informatica e internet.

Allo stesso modo, dice, “oggi abbiamo già un nucleo di intelligenza. Percepiamo che questi modelli hanno un tipo di intelligenza. Forse non allo stesso livello della nostra, ma c’è una scintilla, qualcosa di nuovo. E riusciremo a combinare e ricombinare questo nucleo in una rivoluzione intera”, auspica. “Nel giro di dieci o quindici anni esisteranno applicazioni impensabili oggi, non necessariamente grazie a nuove architetture, ma sfruttando e ricombinando questo nucleo di intelligenza che già esiste oggi”.

Patel individua però due aree in cui le architetture attuali mostrano limiti che non si risolvono semplicemente aumentando il numero di parametri o la potenza di calcolo.

La prima è il tempo. “Gli LLM non hanno alcuna comprensione del tempo. Si può spegnerlo, riaccenderlo due giorni dopo, dargli la stessa sequenza di token, e darà lo stesso output. Per un LLM il concetto di tempo, semplicemente, non esiste”. Lo si può aggirare passando la data nel prompt, ma è una soluzione di rimedio: il modello non percepisce il cambiamento nel mondo, non sa che non può tornare a uno stato precedente.

Gli LLM non hanno alcuna comprensione del tempo. Si può spegnerlo, riaccenderlo due giorni dopo, dargli la stessa sequenza di token, e darà lo stesso output

La seconda è la memoria. Quando si costruiscono agenti AI con accesso a strumenti, la soluzione standard è inserire tutte le informazioni precedenti nella finestra di contesto. “Non è una soluzione particolarmente elegante – dice Patel – È come chiedere a un tassista di portarti da A a B dovendogli dire ogni volta daccapo come funziona un’automobile, quali sono le regole del codice della strada e come è fatta la mappa della città”. Tremendamente inefficiente.

Entrambi i limiti puntano nella stessa direzione: serviranno architetture diverse. Non necessariamente per costruire una “superintelligenza”, ma per rendere i modelli attuali effettivamente utili in scenari dove il tempo conta e la continuità della memoria è un requisito operativo, il che praticamente coincide con qualsiasi contesto aziendale reale.

I modelli open weight/open source nell’IA di frontiera

DW: C’è poi la questione di chi avrà accesso a questi sistemi. La superintelligenza, anche nella forma leggera che ha descritto, si espanderà verso i modelli open weight/open source, o la potenza di calcolo necessaria costituirà un ostacolo competitivo, un “fossato” attorno al castello delle big tech (che al momento manca)?

“Credo che nel tempo sarà tutto molto democratizzato. Il gap tra i migliori modelli closed source ad alto consumo computazionale e i modelli open source si sta riducendo costantemente. E se si hanno casi d’uso molto specializzati, cioè che quel che la maggior parte delle aziende sta cercando in questo momento, puoi prendere modelli open source e addestrarli sul tuo dominio specifico di competenze, superando le prestazioni di qualsiasi modello proprietario”.

Il trend che Patel si aspetta non è la scomparsa dei grandi modelli generalisti, ma la progressiva maturazione del mercato: sempre più organizzazioni impareranno ad addestrare modelli potenti per i propri casi d’uso, spostandosi a monte rispetto al semplice prompt engineering con l’aggiunta di retrieval augmented generation. Un percorso già in corso: Mistral, per esempio, ha appena lanciato un servizio di personalizzazione dei modelli dedicato alle aziende.

sempre più organizzazioni impareranno ad addestrare modelli potenti per i propri casi d’uso, spostandosi a monte rispetto al semplice prompt engineering con l’aggiunta di RAG

Come potremo valutare un’entità che è più intelligente dei suoi creatori?

DW: A un certo punto avremo bisogno di valutare qualcosa che è più intelligente di noi. Riusciremo a farlo?

“Stiamo già entrando in una fase in cui usiamo le AI per valutare le AI”, dice Patel. Per i benchmark più difficili, nessun singolo esperto umano può valutare da solo: servono già team multidisciplinari. Si usano quindi giudici basati su AI, con risposte corrette raccolte e verificate dagli umani come chiave di correzione.

Il punto più importante, però, è un altro: gli evals (le valutazioni sistematiche delle capacità dei modelli) non misurano l’intelligenza in sé, misurano le azioni. “Le valutazioni si basano in larga misura sui risultati nel mondo reale, e quei risultati sono osservabili. Non è una questione di intelligenza; è una questione di azione. Si compie un’azione, e io ne osservo l’esito. Posso quindi dire se l’azione era corretta o no, indipendentemente da chi l’ha compiuta”.

Il funzionamento intuitivo degli LLM e la criticità degli “Evals”

La mappa delle competenze di un’IA rivela un confine molto frastagliato. Eccellenti per alcuni computi, incredibilmente carenti su altri in apparenza più elementari

Nello speech ad Atene, Patel ha introdotto un concetto che chi lavora con l’AI riconosce immediatamente: la mappa dell’intelligenza di un modello non somiglia a un cerchio, ma a una superficie frastagliata. Saper fare bene due cose non implica saper fare bene una terza che è, in teoria, più semplice ed elementare. Fa il celebre esempio di modelli che risolvono teoremi matematici avanzati ma poi non sono in grado di contare quante lettere R ci sono nella parola “strawberry”. Le capacità dei modelli hanno lacune imprevedibili che non si possono ricavare dai benchmark tradizionali.

I modelli, nel frattempo sono migliorati su quel compito specifico, ma il meccanismo sottostante rimane: è possibile fallire su compiti banali pur eccellendo su compiti complessi.

“Il modo in cui le reti neurali funzionano è fondamentalmente intuitivo. Non sono sistemi logici come quelli del passato. Quando si osserva come lavorano, ci si accorge che non stanno ragionando in senso proprio, ma ottengono qualcosa che è più simile all’ intuizione, come spesso facciamo anche noi”.

È l’opposto di quanto la cultura popolare si aspettava: non un tenente comandante Data di Star Trek, super logico ma privo di intuizione. Per superare i limiti dell’aspetto intuitivo e probabilistico, sono stati sviluppati i modelli con ragionamento, cioè quelli che prima di rispondere elaborano una sequenza di operazioni passo a passo: “I reasoning model sono il nostro workaround al fatto che questi modelli sono fondamentalmente intuitivi. Forse questo sarà sufficiente, forse è tutto quel che serve, perché è tutto ciò di cui gli esseri umani hanno mai avuto bisogno”. O forse no.

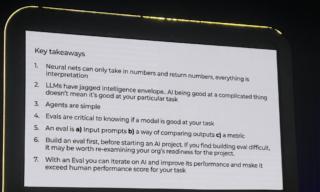

Proprio perché le competenze di un’IA non sono uniformemente distribuite e possono essere falsate da allucinazioni o intuizioni fuori fuoco, Patel sottolinea la necessità di predisporre sistemi di valutazione dei risultati rigorose ed efficaci per i modelli e gli agenti da impiegare nei cicli produttivi, definendo molto bene quali siano i risultati accettabili prima ancora di cominciare un progetto.

I principali punti della presentazione di Patel a EmTech Europe

Il ruolo degli umani e l’esempio di Messi

DW: Si interroga mai sull’impatto che avrà su noi umani il confrontarci con qualcosa di così capace? Personalmente, quando vedo un LLM che produce in pochi minuti un testo basato su una ricerca che a me avrebbe richiesto giorni, mi chiedo quale sarà il mio ruolo in futuro…

“Le persone cominceranno a capire quali sono le caratteristiche che li rendono davvero indispensabili nel proprio lavoro, tra tanti altri compiti che possono e devono essere delegati all’IA. Il mio lavoro è cambiato molto più di quello della maggior parte delle persone. Ora passo relativamente poco tempo a scrivere fisicamente codice – con con grande sollievo per il mio tunnel carpale – e molto tempo a ragionare sugli algoritmi, su come i sistemi devono funzionare, su cosa l’AI non riesce a fare o non capisce come fare, a spiegarle quale codice deve essere scritto”.

“Pensate a Messi, uno dei migliori calciatori del mondo. Se lo osservate in campo, in realtà trascorre dal 95 al 98 percento del tempo a correre da una parte all’altra del campo. L’uno o due percento del tempo ha la palla tra i piedi e ci fa qualcosa. E poi c’è lo 0,01 percento del tempo in cui prende la decisione critica: calciare la palla in quella direzione precisa. Quello 0,01 percento è l’essenza stessa e il valore di Messi.

Se un’AI riuscisse a correre esattamente come Messi e negli stessi spazi in cui va lui, penseremmo che quell’IA rappresenterebbe il 98 percento di Messi? No, perché il 98 percento dei compiti che l’AI può fare non è ciò che rende davvero Messi il campione che è”.

Il 98 percento dei compiti che l’AI può fare non è ciò che rende davvero Messi il campione che è

“Nel mio caso, il tempo dedicato a correre era quello che passavo a scrivere codice. È sparito. Risparmio l’80-90% del tempo. Ed è straordinario, perché ora posso dedicarmi per tutto il tempo a esprimere il mio vero valore, e questo accelera enormemente il mio lavoro”.

Il nuovo ruolo delle aziende e dei loro leader

DW: Spostando il tiro dagli individui alle organizzazioni, anche le aziende devono capire quale sia il loro reale valore aggiunto in un mondo in cui competitor e outsider hanno accesso agli stessi potentissimi modelli. Quali consigli può dare ai CIO e ai leader aziendali?

“Tra le caratteristiche dei leader c’è quella di saper assumere le persone migliori e formarle nel loro lavoro. Oggi questa abilità si trasforma nella capacità di selezionare il miglior modello adatto a un certo ruolo e di saperlo adattare al contesto aziendale in modo da potergli delegare dei compiti”.

Oggi però ogni impiegato delega alcuni compiti all’IA, per cui la capacità di identificare un modello e dargli istruzioni in modo appropriato deve essere coltivata in tutta l’azienda. “Se un tempo un manager aveva dei dipendenti a cui delegare computi, oggi ogni dipendente li sta delegando a un’IA. Il che significa che ogni umano deve avere alcune capacità di leadership”.

Alla fine dell’intervista, una prospettiva che raramente si sente dai laboratori di frontiera. Patel è cresciuto in un villaggio rurale dell’India centrale. Non mancavano le persone intelligenti, dice, ma mancava l’accesso alla conoscenza. “Per la prima volta abbiamo qualcosa che può essere un grande equalizzatore, perché chiunque può facilmente avere il potere di fare cose che prima erano molto difficili e l’unica competenza richiesta è quella di saper scrivere e fare domande”. Una barriera di accesso sostanzialmente inferiore a qualsiasi requisito di accesso alla tecnologia che sia mai esistito nella storia.

È un punto che vale la pena tenere a mente quando si discute di evals, architetture e benchmark: la posta in gioco non è solo tecnologica.