Claude Auto Mode ora corregge il tuo codice. Nuove integrazioni mobile con Figma, Slack e Canva

Nelle scorse ore, Anthropic ha rilasciato due importanti aggiornamenti a Claude. Il primo è l’anteprima di Auto Mode all’interno di Claude Code. Questa nuova funzionalità nasce per trovare un punto di equilibrio tra due estremi che, fino ad ora, costringevano gli sviluppatori a una scelta scomoda.

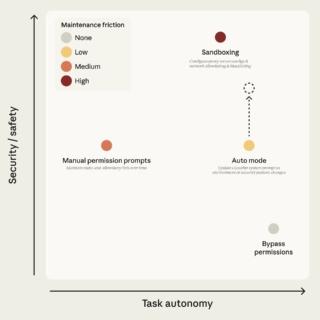

Da un lato c’è il comportamento predefinito di Claude Code che richiede un’approvazione esplicita per ogni scrittura di file e ogni comando bash, cosa utile in termini di controllo ma frustrante quando si lavora su task ripetitivi o pipeline automatizzate. Dall’altro lato c’è il flag “–dangerously-skip-permissions”, che alcuni sviluppatori usano per far operare Claude in piena autonomia, accettando implicitamente qualsiasi rischio operativo.

L’auto mode si inserisce tra questi due estremi con un approccio più sofisticato, grazie a un sistema di classificazione che valuta in tempo reale le azioni che Claude sta per eseguire. Se il classificatore le ritiene sicure, procede autonomamente senza richiedere intervento umano. Se invece rileva un potenziale rischio, redirige il modello verso un approccio alternativo più cauto. L’obiettivo dichiarato di Anthropic è ridurre la probabilità che Claude esegua operazioni ad alto impatto negativo come cancellazioni massive di file, estrazione di dati sensibili o esecuzione di codice potenzialmente malevolo.

L’Auto Mode punta a un’elevata autonomia con bassi costi di manutenzione; la freccia tratteggiata mostra il miglioramento della sicurezza nel tempo, man mano che la copertura del classificatore e la precisione del modello aumentano.

Anthropic è però esplicita sui limiti del sistema, precisando che il classificatore può comunque autorizzare azioni rischiose nei casi in cui l’intenzione dell’utente sia ambigua, o se Claude non dispone di contesto sufficiente per valutare correttamente il rischio specifico di quell’ambiente. Non è quindi una rete di sicurezza assoluta, ma un livello di protezione aggiuntivo e contestuale.

Anthropic non cita esplicitamente alcun episodio come ispirazione per questa funzionalità, ma il tempismo è difficile da ignorare. Il blackout di AWS del mese scorso, attribuito all’eliminazione accidentale di un intero ambiente di hosting da parte di uno strumento AI con permessi più ampi del necessario, ha reso evidente quanto il tema della granularità dei permessi negli agenti autonomi sia urgente e concreto. Amazon ha classificato l’accaduto come errore umano, ma rimane la questione di fondo di quanto controllo sia giusto delegare a un sistema automatizzato.

L’auto mode è disponibile da oggi in anteprima per gli utenti del piano Team, mentre il rollout verso gli utenti Enterprise e API è previsto nei prossimi giorni.

La seconda novità riguarda l’integrazione nell’app mobile di Claude di strumenti di lavoro come Figma, Canva e le dashboard di Amplitude. Una novità che consente agli utenti di accedere a progetti grafici e analisi e di creare presentazioni direttamente dal proprio smartphone. L’aggiornamento centralizza i flussi di lavoro in un’unica app ed è stato presentato tramite un video pubblicato su X dall’azienda. Anthropic ha infine anticipato alcune funzionalità future, tra cui una presunta feature di accesso da smartphone denominata “Orbit”.