GPT-5.4 mini e nano sono i nuovi modelli light di OpenAI per utenti free e chi ha finito i crediti

OpnAI ha da poco introdotto GPT‑5.4 mini e nano, versioni compatte che portano molte delle capacità di GPT‑5.4 in modelli più veloci ed efficienti per carichi di lavoro ad alto volume.

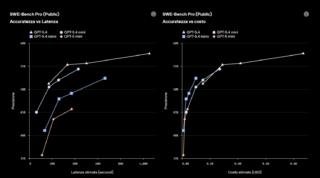

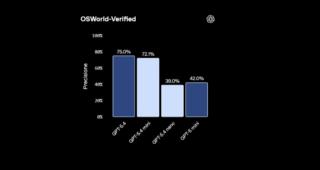

GPT‑5.4 mini migliora significativamente GPT‑5 mini in programmazione, ragionamento, comprensione multimodale e uso degli strumenti, con una velocità più che raddoppiata. Si avvicina inoltre alle prestazioni del modello GPT‑5.4 più grande in diversi benchmark, tra cui SWE-Bench Pro e OSWorld-Verified.

GPT‑5.4 nano è la versione più piccola e più conveniente di GPT‑5.4 per le attività in cui velocità e costo sono prioritari. Rappresenta anche un miglioramento significativo rispetto a GPT‑5 nano e OpenAI lo consiglia per classificazione, estrazione dei dati, ranking e sotto-agenti di programmazione che gestiscono attività di supporto più semplici.

Questi modelli sono progettati per carichi di lavoro in cui la latenza influisce direttamente sull’esperienza del prodotto. OpenAI cita assistenti di programmazione che devono essere reattivi, sotto-agenti che completano rapidamente attività di supporto, sistemi che utilizzano il computer e acquisiscono e interpretano screenshot e applicazioni multimodali in grado di ragionare sulle immagini in tempo reale. In questi contesti, il modello migliore spesso non è il più grande, ma è quello che risponde rapidamente, usa gli strumenti in modo affidabile e mantiene prestazioni elevate anche in attività professionali complesse.

GPT‑5.4 mini e nano sono particolarmente efficaci nei flussi di lavoro di programmazione che beneficiano di iterazioni rapide. I modelli gestiscono infatti modifiche mirate, la navigazione nel codebase, la generazione di front-end e cicli di debugging con bassa latenza, risultando particolarmente adatti alle attività di programmazione che richiedono maggiore velocità e costi inferiori.

GPT‑5.4 mini è anche una soluzione efficace per sistemi che combinano modelli di dimensioni diverse. In Codex, ad esempio, un modello più grande come GPT‑5.4 può occuparsi di pianificazione, coordinamento e decisione finale, delegando ai subagenti GPT‑5.4 mini sottocompiti più specifici in parallelo, come cercare nel codebase, revisionare file di grandi dimensioni o elaborare documenti di supporto.

Questo approccio diventa più utile man mano che i modelli più piccoli diventano più veloci e capaci. Invece di usare un unico modello per tutto, gli sviluppatori possono creare sistemi in cui i modelli più grandi decidono cosa fare e quelli più piccoli eseguono rapidamente le attività su larga scala. “GPT‑5.4 mini è il nostro mini modello ad oggi più potente per questo tipo di flusso di lavoro”, si legge nel comunicato di OpenAI.

GPT‑5.4 mini offre ottime prestazioni anche nelle attività multimodali, in particolare in quelle legate all’uso del computer. Il modello può infatti interpretare rapidamente screenshot di interfacce utente complesse per completare più velocemente attività legate all’uso del computer, tanto che su OSWorld-Verified GPT‑5.4 mini si avvicina a GPT‑5.4 superando nettamente GPT‑5 mini.

Per quanto riguarda disponibilità e prezzi, GPT‑5.4 mini è disponibile da oggi nell’API, in Codex e su ChatGPT. Nell’API, supporta input di testo e immagini, uso degli strumenti, function calling, ricerca web, ricerca di file, uso del computer e skills. Ha una finestra di contesto da 400k token e costa 0,75 dollari per 1M token di input e 4,50 dollari per 1M token di output.

In Codex, GPT‑5.4 mini è disponibile nell’app Codex, nella CLI, nell’estensione IDE e sul web. Utilizza solo il 30% della quota di GPT‑5.4, consentendo agli sviluppatori di gestire rapidamente attività di programmazione più semplici in Codex a circa un terzo del costo. Codex può anche delegare a subagenti GPT‑5.4 mini, in modo che le attività meno intensive dal punto di vista del ragionamento vengano eseguite sul modello più economico. Su ChatGPT, GPT‑5.4 mini è disponibile per gli utenti Free e Go tramite la funzionalità “Thinking” nel menu +. Per tutti gli altri utenti, è disponibile come fallback quando viene raggiunto il limite di velocità di GPT‑5.4 Thinking.

GPT‑5.4 nano è disponibile solo nell’API e costa 0,20 dollari per 1M di token di input e 1,25 dollari per 1M di token di output.