NVIDIA lancia Nemotron 3 Super: modello open da 120B parametri per l’AI agentica enterprise

NVIDIA ha annunciato nelle scorse ore la disponibilità di Nemotron 3 Super, un nuovo modello IA progettato specificamente per applicazioni multi-agente ad alta intensità computazionale, come lo sviluppo software automatizzato o il triage di incidenti di cybersecurity. Un LLM che rappresenta l’evoluzione della famiglia Nemotron dopo l’introduzione del più compatto Nemotron 3 Nano avvenuta alla fine del 2025.

Il contesto tecnico in cui nasce Nemotron 3 Super è caratterizzato da una dinamica per cui le applicazioni basate su più agenti generano un volume di token nettamente superiore rispetto a una normale interazione con un modello linguistico. Ogni ciclo operativo include infatti la cronologia delle conversazioni, i risultati degli strumenti utilizzati e le catene di ragionamento intermedie. Questo fenomeno, spesso definito “context explosion”, può produrre effetti indesiderati nei processi decisionali dell’agente, portando progressivamente a una perdita di allineamento rispetto all’obiettivo iniziale del task.

A questa complessità si aggiunge il cosiddetto “thinking tax”, ovvero il costo computazionale associato all’utilizzo di modelli di ragionamento molto grandi per ogni singola sotto-attività. In un sistema multi-agente composto da numerosi moduli cooperanti, questa tassa computazionale può rendere l’intero sistema troppo costoso o lento per applicazioni reali.

Nemotron 3 Super nasce con l’obiettivo di ridurre entrambe queste criticità. Il modello utilizza un’architettura ibrida di tipo mixture-of-experts (MoE), con 120 miliardi di parametri complessivi ma soltanto 12 miliardi attivi per singola inferenza. Questo approccio consente di aumentare la capacità del modello mantenendo un consumo di risorse relativamente contenuto. Secondo NVIDIA, la nuova architettura garantisce un throughput superiore di oltre cinque volte rispetto alla generazione precedente della piattaforma Nemotron.

Uno degli elementi più rilevanti è l’adozione di una finestra di contesto nativa da un milione di token. Questa capacità permette agli agenti di mantenere una memoria operativa molto più ampia durante task prolungati, riducendo il rischio di perdere informazioni cruciali o di deviare progressivamente dagli obiettivi iniziali. In scenari complessi come debugging automatizzato o analisi di incidenti di sicurezza, la possibilità di gestire contesti così estesi rappresenta un vantaggio significativo.

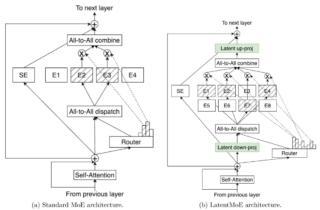

Il modello introduce anche diverse innovazioni architetturali mirate a migliorare l’equilibrio tra accuratezza e prestazioni. Una delle più interessanti è la cosiddetta Latent MoE, un sistema che comprime i token prima dell’elaborazione da parte degli “esperti” specializzati. In questo modo il modello può coinvolgere un numero maggiore di esperti per ogni inferenza mantenendo lo stesso costo computazionale.

Un’altra componente chiave è la tecnica di multi-token prediction. Invece di generare un singolo token per ogni passaggio di inferenza, il modello è in grado di prevedere più token futuri in una sola operazione. Questo riduce significativamente il tempo necessario per generare sequenze lunghe e abilita meccanismi di speculative decoding integrati.

Nemotron 3 Super utilizza inoltre un backbone ibrido che combina elementi delle architetture Transformer con strati basati sul modello Mamba, progettato per gestire sequenze lunghe in modo più efficiente. L’integrazione delle due tecnologie consente di migliorare l’efficienza nella gestione della memoria e della potenza di calcolo, mantenendo al tempo stesso la precisione del ragionamento tipica dei modelli Transformer.

L’ottimizzazione del modello è stata progettata anche in funzione delle nuove architetture hardware. Il pretraining utilizza il formato numerico NVFP4, ottimizzato per i sistemi basati su GPU della generazione NVIDIA Blackwell. Secondo i dati diffusi dall’azienda, questa scelta riduce significativamente i requisiti di memoria e accelera l’inferenza fino a quattro volte sui sistemi NVIDIA B200 rispetto alle implementazioni FP8 su NVIDIA H100.

Il modello è stato ulteriormente raffinato attraverso tecniche di reinforcement learning applicate in ambienti simulati multipli. L’addestramento ha coinvolto 21 configurazioni differenti utilizzando gli strumenti NVIDIA NeMo Gym e NVIDIA NeMo RL, con oltre 1,2 milioni di cicli di simulazione utilizzati per migliorare le capacità decisionali degli agenti.

Le prestazioni del sistema sono state valutate utilizzando PinchBench, un benchmark progettato per misurare l’efficacia dei modelli linguistici quando operano come motore cognitivo di agenti autonomi. In questo contesto, Nemotron 3 Super ha ottenuto un punteggio complessivo dell’85,6%, posizionandosi come uno dei modelli open più performanti della sua categoria per applicazioni agentiche avanzate.