F5 porta a Milano il suo cloud per il delivery delle app e punta sulla sicurezza AI

Indice dell'articolo

F5 ha compiuto trent’anni di storia nell’application delivery e security, ha aperto un punto di presenza a Milano e ampliato la propria offerta per la sicurezza dell’AI. Alla conferenza stampa italiana l’azienda ha illustrato la propria piattaforma unificata ADSP (Application Delivery and Security Platform) e le iniziative per accompagnare i clienti enterprise nell’era del multicloud, visto anche in ottica di resilienza in un panorama incerto, e dell’AI agentica.

F5 nasce nel 1996 con l’obiettivo di distribuire e proteggere le applicazioni in rete, indipendentemente da dove si trovino e da come siano sviluppate. “Il motto non è mai cambiato in trent’anni: application delivery e application security su qualsiasi tipo di applicazione, ovunque si trovi e comunque sia stata sviluppata”, ricorda Paolo Arcagni, Director South EMEA e Presales Manager Italia di F5.

Il percorso parte da BIG-IP, l’Application Delivery Controller che F5 ha contribuito a definire come categoria insieme a Gartner, dotato del sistema operativo proprietario TMOS (Traffic Management Operating System). Nel tempo, BIG-IP si è adattato alla virtualizzazione, al public cloud e ai container. A questo si è affiancato NGINX, nato come web server open source ma presto diventato riferimento di fatto nel load balancing e oggi usato come ingress controller negli ambienti Kubernetes.

Paolo Arcagni, Director South EMEA e Presales Manager Italia di F5

Dal 2019, una serie di acquisizioni in ambito security e intelligenza artificiale ha completato l’offerta. La più significativa in termini di storia recente è stata Volterra nel 2021, oggi rinominata F5 Distributed Cloud Services: una rete globale overlay con SaaS integrato per centralizzare le policy di sicurezza e gestire il delivery di applicazioni su una dorsale ad alte prestazioni indipendentemente dal cloud su cui sono ospitate.

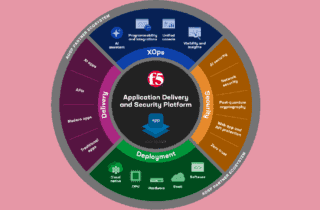

Il risultato di questa evoluzione è l’ADSP, piattaforma che unifica le tre anime di F5 – software (NGINX), hardware e software combinati (BIG-IP), SaaS (Distributed Cloud Services) – in un’offerta coerente che copre application delivery, API security, multicloud networking e, più di recente, sicurezza AI in modalità as-a-Service.

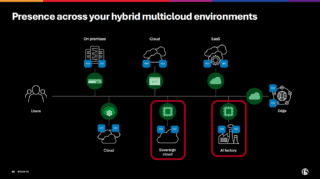

Uno dei valori architetturali fondamentali che F5 porta ai clienti è l’avversione al lock-in. “Se a un certo punto voglio spostare la mia applicazione da Azure ad AWS, non devo riprogrammare tutte le policy di application delivery e security perché il frontend – che sia NGINX o BIG-IP – funziona esattamente allo stesso modo su qualsiasi cloud”, sottolinea Arcagni.

Il PoP di Milano e la clientela italiana

Dallo scorso 29 gennaio, con l’apertura di un punto di presenza a Milano, F5 e porta anche in Italia la piena operatività dell’ADSP in modalità SaaS: routing cloud-native, bilanciamento del carico, protezione DDoS L3-L7, sicurezza applicativa e di rete e orchestrazione Kubernetes. La capacità di rete disponibile supera i 15 Tbps su backbone privato ridondante.

Il tema che fa da sfondo è quello della sovranità del dato, sentito in Europa specialmente dalla pubblica amministrazione, settore in cui F5 è parecchio attiva. “Per molti clienti è importante che il PoP sia in Italia, che i dati restino qui”, dice Paolo Capomasi, Country Manager di F5 per l’Italia.

Paolo Capomasi, Country Manager di F5 per l’Italia

Il contesto normativo europeo – dal GDPR alla direttiva DORA per i servizi finanziari – sta spingendo alcune organizzazioni a un fenomeno di data repatriation: aziende che avevano migrato quasi tutto sul cloud pubblico stanno riportando carichi di lavoro nei propri data center per ragioni di conformità e controllo.

F5 risponde anche a questa esigenza con un meccanismo chiamato Customer Edge: un software installabile nel data center privato del cliente che estende la rete F5 nell’infrastruttura on-premises, consentendo una gestione multicloud unificata senza fare uscire i dati dal perimetro aziendale.

F5 e l’intelligenza artificiale: quattro fronti aperti

I manager hanno poi fatto il punto sulla traiettoria dell’azienda nel mondo dell’intelligenza artificiale, declinata su quattro aspetti distinti.

Sicurezza AI

L’acquisizione di CalypsoAI, completata nel quarto trimestre del 2025 per 180 milioni di dollari, porta in F5 due prodotti specifici per proteggere gli ambienti basati su LLM.

Il primo è AI Red Team, un servizio SaaS che testa continuamente i motori AI attraverso agenti automatici che simulano attacchi di prompt injection, tecniche di jailbreak e altri vettori specifici dell’AI. Il secondo è AI Guardrails, che opera a livello di inferenza per definire cosa può e non può fare un LLM, rilevare fughe di dati sensibili e garantire la conformità a GDPR e AI Act europeo.

“Le protezioni deterministiche, come le regole dei firewall, non sono più adeguate all’era dell’AI. Il Web Application Firewall protegge il frontend, ma non è utile sul backend di un’applicazione AI: se modifico leggermente il prompt posso ottenere una risposta diversa e non prevista. In questo contesto, la sicurezza non può essere deterministica”, ha spiegato Arcagni. Capomasi ha aggiunto una considerazione di governance: i clienti hanno tipicamente molti LLM in produzione e hanno bisogno di una governance unica per tutti, non di soluzioni separate per ciascuno.

CalypsoAI genera e testa oltre 10.000 nuovi prompt di attacco ogni mese, con produzione di punteggi di rischio per ogni motore testato. F5 Labs – la divisione di ricerca sulla sicurezza applicativa – usa già Red Team per pubblicare classificazioni di sicurezza dei principali modelli pubblici. Nel quadro della sicurezza, Arcagni ha citato anche la crittografia post-quantistica: F5 sta seguendo l’evoluzione degli standard NIST e nel 2026 i Distributed Cloud Services saranno equipaggiati per la crittografia resistente ai computer quantistici, con un’enfasi sulla cosiddetta crypto-agility, cioè la capacità di aggiornare rapidamente gli algoritmi crittografici in modo centralizzato senza dover intervenire su migliaia di server.

AI factory e integrazione con NVIDIA

Un secondo fronte riguarda l’infrastruttura fisica su cui girano i modelli. “Il problema fondamentale è che ci sono GPU da miliardi di dollari che restano sottoutilizzate perché i dati non arrivano abbastanza velocemente”, dice Arcagni.

La risposta di F5 prevede di integrare il core di BIG-IP (nella variante BIG-IP Next for Kubernetes) direttamente sulle DPU (Data Processing Unit) di NVIDIA, entrando nell’architettura di riferimento ufficiale del produttore di chip. L’integrazione risolve due problemi: distribuisce il traffico in modo intelligente verso le GPU meno cariche in un dato momento, e consente il multi-tenancy all’interno di un singolo cluster NVIDIA, una capacità che oggi manca nell’architettura standard e che impedisce a chi offre GPU as-a-service di ospitare più clienti nello stesso ambiente.

F5 Insight

Il terzo fronte è l’uso dell’AI all’interno delle operations sulla piattaforma stessa. Arcagni ha anticipato F5 Insight, prodotto in fase di annuncio all’evento AppWorld di Las Vegas: un motore che raccoglie dati da tutti i componenti della piattaforma – hardware, software, SaaS – e li rende interrogabili in linguaggio naturale.

“Invece di setacciare una serie di log per sapere cosa è successo il 2 febbraio 2026, posso fare una domanda in linguaggio naturale alla piattaforma e ottenere una risposta strutturata su tutti gli eventi di sicurezza di quella giornata”, ha spiegato.

AI agentica e protocollo MCP

Il quarto fronte è ancora in formazione, ma già presente nelle conversazioni con i clienti. La proliferazione di agenti AI autonomi pone problemi nuovi per l’application delivery e security: un agente che interagisce con un’applicazione si comporta in modo diverso da un utente umano, ma anche da un bot tradizionale.

F5 sta già lavorando sul supporto al protocollo MCP (Model Context Protocol), lo standard emergente per la comunicazione tra agenti AI e servizi esterni. Arcagni ha distinto due categorie: i “people AI”, agenti intelligenti che emulano comportamenti umani e rientrano nel perimetro della bot protection esistente, e gli agenti AI nel senso proprio – sistemi che orchestrano più agenti per completare task complessi – che pongono sfide ancora aperte.

Modello commerciale e canale

L’ADSP è disponibile anche in modalità MSP (Managed Service Provider): Telefónica in Spagna, ad esempio, eroga application delivery e security ai propri clienti su infrastruttura F5.

Il modello di pricing è basato su subscription e volumi di traffico, con addendum per funzionalità specifiche – bot management, DDoS protection, WAF, multicloud networking – e per l’eventuale Customer Edge installato on-premises. F5 conta circa 300 system integrator tra i propri partner.