“Non basta un’AI etica per rendere etico il business”: la strategia di SAS per l’innovazione responsabile

Alla guida della divisione Data Ethics Practice di SAS, e con un passato da membro della National Advisory sull’AI dell’Amministrazione Biden, Reggie Townsend si occupa e si preoccupa che le soluzioni dell’azienda – e in particolare quelle che riguardano dati e AI – rispettino le leggi e l’etica dettate dalle sensibilità delle diverse regioni in cui opera, assicurandosi che promuovano il benessere e l’equità sociale.

Lo abbiamo incontrato nella sede di Milano, di passaggio in un tour che lo porterà a incontrare clienti in altre capitali europee, e abbiamo potuto approfondire con lui come, nel suo ruolo, aiuta SAS e i clienti ad addentrarsi in un territorio ancora poco esplorato, come quello dell’etica dell’AI.

L’etica è definita dal consenso sociale

Reggie Townsend, Vice President della Data Ethics Practice di SAS

Per Townsend, l’approccio all’etica dell’intelligenza artificiale deve partire da un presupposto fondamentale: “Penso all’etica in termini di consenso sociale. Questo significa che coloro che fanno parte di un gruppo, di una società, hanno l’opportunità di dire ciò che credono sia appropriato”. Da questa visione deriva una conseguenza pratica importante: “nessuna singola persona è responsabile dell’etica”.

Il ruolo di Townsend in SAS riflette questa filosofia: più che dettare regole dall’alto, si concentra sul garantire che “ovunque si trovi il nostro software, non danneggi le persone” e che l’azienda innovi “nei modi più responsabili rispetto alle culture e giurisdizioni in cui operiamo”.

Governance dell’AI: quattro pillar per l’innovazione responsabile

Nella pratica, SAS ha sviluppato una metodologia di governance AI strutturata su quattro pilastri fondamentali. “La governance va di pari passo con l’abilitazione”, spiega Townsend, evidenziando come non abbia senso cercare di avere un’enorme struttura di governance a priori se non si intende realizzare nulla, ma allo stesso tempo “non si può pensare di portare dei progetti in produzione senza una qualche forma di considerazione per capire come vengono utilizzate o vincoli di utilizzo”.

I quattro pilastri del modello SAS comprendono: oversight (supervisione esecutiva), controls (conformità legale e policy interne), operations (tecnologie necessarie per realizzare i valori aziendali) e culture (comportamenti normativi necessari per l’enterprise). L’approccio “ethical by design” richiede che “questi pilastri vengano ben posizionati prima ancora di raccogliere dati o scrivere una riga di codice”.

Tutto comincia dai dati

La filosofia etica di SAS si concretizza in pratiche tecniche specifiche, partendo dalla qualità dei dati. “Le aziende dovrebbero chiedersi: stiamo acquisendo dati in modi che sono efficaci e adatti allo scopo? I dati sono sufficientemente puliti e di qualità per essere utilizzati?”.

L’azienda pone grande enfasi sull’identificazione e mitigazione dei bias, partendo dal principio che “tutti i dati sono distorti rispetto alla realtà, quindi la questione è se quel bias sia dannoso o meno”. L’obiettivo è identificare i bias potenzialmente dannosi e implementare correzioni prima che possano dare origine a un danno.

Un aspetto spesso trascurato ma cruciale riguarda la gestione dell’intero ciclo di vita dei modelli: “Non tutti i modelli devono vivere per sempre. I dati invecchiano, e a un certo punto, devi mettere a riposo i modelli”. Questo include anche una gestione responsabile dei dati su cui sono stati addestrati.

Non tutti i modelli devono vivere per sempre. I dati invecchiano, e a un certo punto, li devi mettere a riposo

I rischi dell’Agentic AI

L’evoluzione verso sistemi di AI autonomi presenta nuove sfide etiche. Quando si delegano azioni ad agenti senza intervento umano, è necessario fare un’attenta analisi dei rischi a cui l’azienda si espone.

Ma c’è anche un rischio a lungo termine, nella selezione e formazione del personale del futuro. Townsend identifica infatti un problema particolare nell’automazione di compiti tradizionalmente assegnati ai professionisti junior: “Quello che sta succedendo è che stiamo rendendo automatiche alcune delle parti più semplici del nostro lavoro che comunemente assegniamo ai giovani professionisti”.

La grande domanda diventa: “L’AI agentica ha un effetto dannoso sui professionisti all’inizio della carriera?”. Mentre i dati sull’occupazione iniziano a suggerire una risposta affermativa (crescono le assunzioni e le retribuzioni di profili senior, mentre si fermano quelle dei junior), Townsend mantiene una posizione cauta: la valutazione è ancora in corso, ma è necessario considerare come potremo formare i futuri senior, se si automatizzano tutti i ruoli entry-level.

È necessario considerare come potremo formare i futuri senior, se si automatizzano tutti i ruoli entry-level

Bilanciare diritti individuali e vantaggi sociali

Un esempio concreto delle sfide etiche che le aziende stanno affrontando emerge dal caso del “worker safety” di SAS. La tecnologia può monitorare la sicurezza dei lavoratori in ambito industriale, identificando con telecamere comportamenti rischiosi o situazioni di pericolo, ma “alcuni potrebbero sostenere che si tratta di uno strumento di sorveglianza dei dipendenti”. La stessa tecnologia, inoltre, applicata fuori dal contesto industriale, può essere impiegata per sorveglianza e controllo sociale.

Questa ambiguità sottolinea la dipendenza delle valutazioni della tecnologia dall’effettivo utilizzo che se ne fa, e l’importanza del contesto geografico: quello che è eticamente accettabile in Cina potrebbe non esserlo in Italia, creando decisioni commerciali complesse per le aziende tecnologiche globali.

Come funziona il dipartimento di Etica in SAS

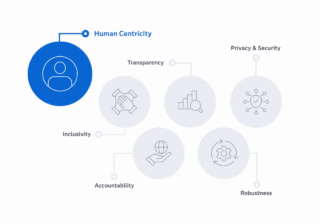

I principi chiave dell’etica AI di SAS, dalla pagina Responsible Innovation sul sito di SAS

Il team di Townsend opera come “influencer” piuttosto che come organo di controllo assoluto. Si occupa di redigere le model cards, che sono ” come le etichette nutrizionali per i modelli AI” e aiutano a determinare se un modello sta performando secondo le aspettative o sta derivando verso comportamenti problematici.

Il team è multidisciplinare, combinando competenze tecnologiche, filosofiche, legali e di gestione prodotto, riflettendo la natura trasversale delle sfide etiche nell’AI.

Non c’è quindi un potere di veto assoluto nei confronti della messa sul mercato di un modello o una soluzione, ma piuttosto un compito di sorveglianza e il potere/dovere di segnalare situazioni problematiche ai livelli più alti dell’organizzazione, in modo che le considerazioni etiche siano adeguatamente rappresentate e possano essere prese decisioni informate.

Un’AI etica non renderà automaticamente più etico il business

Per le organizzazioni che si avvicinano per la prima volta alle questioni etiche dell’AI, Townsend è chiaro: “Devono iniziare con una definizione di propri principi rigorosi, e poi applicarli all’AI. Devono avere un’idea chiara di come scelgono di governare l’AI per sé stessi, e poi valutare i fornitori secondo i loro insiemi di valori”.

Alla domanda se l’attenzione crescente verso l’AI etica stia rendendo il business più etico in generale, Townsend è perentorio e risponde con un netto “No”. La sua spiegazione è pragmatica: “Il fatto che una capacità o un’informazione esista, non significa che le persone e le aziende le utilizzeranno”.

Il fatto che una capacità o un’informazione esista, non significa che le persone e le aziende le utilizzeranno

“Ci sono scelte che gli umani fanno nonostante la conoscenza. Solo perché hai un’informazione migliore, non significa che utilizzerai quella conoscenza per un’azione migliore”, conclude Townsend, sottolineando come la tecnologia etica sia solo uno strumento: l’elemento umano rimane centrale nelle decisioni morali aziendali. Del resto, di Business Ethics si parla da decenni, ma questo non ha impedito alle aziende di prendere decisioni poco etiche.

La visione di SAS suggerisce che l’etica nell’AI non sia una destinazione ma un processo continuo, che richiede strutture organizzative adeguate, competenze multidisciplinari e, soprattutto, la volontà di applicare principi etici anche quando questo potrebbe complicare le decisioni commerciali.