Con l’impatto crescente dei bot IA sul traffico web, si rischiano attacchi DDOS

Negli ultimi mesi si sta assistendo a una trasformazione significativa nella natura del traffico automatizzato sul web. Un recente report pubblicato da Fastly, fornitore di servizi edge cloud, mette infatti in luce una crescita senza precedenti dei bot alimentati IA, con cifre che stanno ridisegnando l’equilibrio tra traffico umano e traffico automatizzato.

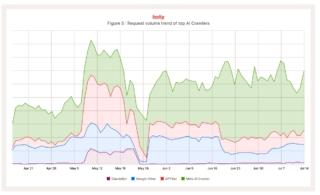

L’analisi, condotta tra il 16 aprile e il 15 luglio su due soluzioni dell’azienda (Next Gen WAF e Bot Management) evidenzia come gli AI crawler costituiscano quasi l’80% del traffico bot IA osservato. Un dato che sorprende non solo per le dimensioni, ma soprattutto per la concentrazione delle responsabilità: Meta da sola genera il 52% del traffico degli AI crawler, più del doppio rispetto a Google (23%) e OpenAI (20%) messi insieme.

Crawler e fetcher: due categorie di bot IA

Fastly distingue tra due principali tipologie di bot IA: i crawler e i fetcher. I primi operano in maniera simile ai crawler dei motori di ricerca tradizionali, scansionando sistematicamente i siti web per raccogliere contenuti destinati a creare indici consultabili o a fornire materiale per l’addestramento dei modelli linguistici. Si tratta quindi di un’attività preliminare alla fase di training dei sistemi di intelligenza artificiale.

I fetcher, invece, recuperano contenuti in tempo reale in risposta a specifiche azioni dell’utente. Per esempio, quando qualcuno chiede a un modello di generare un aggiornamento su un tema specifico, il fetcher consulta immediatamente la fonte e restituisce i dati richiesti e questi bot aiutano a presentare all’utente i link più rilevanti durante una ricerca. L’analisi di Fastly mostra che gli AI crawler rappresentano circa l’80% del volume totale delle richieste, mentre i fetcher si fermano al 20%.

Uno degli aspetti più critici segnalati dal report riguarda l’intensità con cui i bot IA interrogano i siti web. Mentre un singolo crawler può arrivare a 1.000 richieste al minuto, i fetcher risultano molto più aggressivi; in un caso, un fetcher bot ha addirittura generato fino a 39.000 richieste al minuto verso un singolo sito, un volume capace di sovraccaricare i server d’origine e produrre effetti paragonabili a un attacco DDoS, anche senza alcuna intenzionalità malevola.

Questa mole di traffico rischia di compromettere non solo le prestazioni dei siti, ma anche la stabilità delle infrastrutture, incidendo su costi di banda, risorse server e continuità dei servizi. Per aziende e webmaster, ciò significa trovarsi di fronte a un fenomeno che non è semplicemente fastidioso, ma potenzialmente dannoso sul piano economico e operativo.

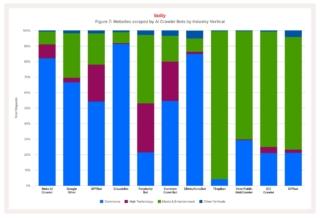

Non tutte le industrie subiscono la stessa pressione. Secondo il report, i comparti più soggetti a scraping per l’addestramento dei modelli AI sono quelli ad alto valore informativo e aggiornamento costante come tecnologia, commercio, media ed entertainment. In particolare, OpenAI si distingue per l’intensità dei fetcher: il 98% delle richieste in tempo reale ai siti web arriva infatti dai bot legati a ChatGPT, confermando il ruolo centrale della piattaforma nel plasmare il nuovo ecosistema informativo.

Preoccupazioni e implicazioni

Matthew Mathur, senior security researcher di Fastly, ha sottolineato come il fenomeno rappresenti una sfida crescente per l’intero settore. L’aumento massiccio del traffico dei bot IA solleva questioni che spaziano dalla privacy alla sicurezza, fino alla distorsione delle metriche di analytics. Infatti, un sito che riceve milioni di visite da bot potrebbe vedere compromessa la propria capacità di misurare il reale comportamento dei visitatori umani, con effetti diretti su marketing e strategie di business.

Dello stesso avviso è Reddy Doddipalli, technical counselor di Info-Tech Research Group, secondo il quale l’esplosione dei modelli generativi e dei sistemi embedded ha alimentato una domanda crescente di dati su larga scala. Se da un lato questo permette alle aziende tecnologiche di addestrare modelli sempre più sofisticati, dall’altro gli effetti collaterali si riflettono sulle imprese che subiscono scraping intensivo dei propri contenuti, con impatti su proprietà intellettuale, etica e sostenibilità delle infrastrutture.

Un ulteriore elemento da considerare è il rapporto ambiguo che si sta creando tra i siti web e le piattaforme IA. L’inclusione dei contenuti online nei dataset di addestramento potrebbe teoricamente offrire visibilità e valore indiretto ai siti, quando gli utenti utilizzano strumenti come ChatGPT per informarsi o prendere decisioni di acquisto. Tuttavia, allo stato attuale, il flusso sembra essere principalmente unidirezionale; le IA, in pratica, si nutrono dei contenuti senza restituire traffico significativo ai siti, come invece facevano i motori di ricerca tradizionali.

Il rischio è quello della disintermediazione. Se un modello restituisce risposte direttamente all’utente, senza indirizzarlo verso le fonti originarie, i siti web perdono la possibilità di monetizzare tramite visite e conversioni. A questo si aggiunge il pericolo che i modelli generativi producano allucinazioni o informazioni errate sui brand, con conseguenze potenzialmente dannose e, cosa ancora più grave, qualcuno potrebbe deliberatamente manipolare i dati per avvelenare i modelli e screditare un’azienda.

Oltre ai rischi economici, si profilano scenari di sicurezza da non sottovalutare. L’enorme mole di richieste generate dai bot IA potrebbe presto essere sfruttata come componente di nuovi attacchi DDoS, rendendo ancora più difficile la difesa delle infrastrutture. Per questo, Fastly invita le organizzazioni a dotarsi di strategie di bot management avanzato, combinando strumenti come il file robots.txt, sistemi di rate limiting e soluzioni dedicate di monitoraggio e mitigazione.

Il problema, tuttavia, è che mentre le grandi aziende iniziano a sviluppare approcci sofisticati per limitare i danni, una vasta fetta di siti più piccoli e sviluppatori indipendenti rischia di trovarsi impreparata, senza la consapevolezza né le risorse per gestire un traffico così massiccio e sempre più opaco.