Il braccialetto Bluetooth di Meta trasforma i movimenti muscolari in comandi per computer in tempo reale

I ricercatori di Meta Reality Labs hanno sviluppato un innovativo braccialetto che trasforma i segnali muscolari in comandi digitali in tempo reale, senza bisogno di telecamere, tastiere, schermi touch o impianti invasivi. Il progetto è stato illustrato in uno studio peer-reviewed pubblicato su Nature, che descrive nei dettagli il funzionamento del dispositivo, potenzialmente destinato a rivoluzionare l’interazione uomo-macchina.

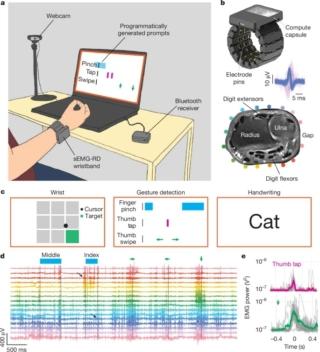

Il dispositivo si indossa come un normale braccialetto e utilizza una tecnologia chiamata elettromiografia di superficie (sEMG). Attraverso elettrodi posizionati sulla pelle, il sistema rileva le microscariche elettriche generate dalla contrazione dei muscoli del polso e della mano. Questi segnali vengono quindi trasmessi via Bluetooth a un computer, dove un modello di intelligenza artificiale li traduce in azioni concrete come spostare un cursore, selezionare comandi o scrivere testo a mano.

A guidare la ricerca sono stati Patrick Kaifosh, direttore scientifico presso Meta Reality Labs, e Thomas Reardon, vicepresidente della divisione ricerca. Il team ha dimostrato che il sistema è in grado di riconoscere gesti in tempo reale, permettendo così un’interazione completa con l’interfaccia grafica di un computer o di un visore AR/VR.

Nessuna calibrazione personale, niente impianti

A differenza di molte altre interfacce neurali basate su segnali muscolari o cerebrali, che richiedono un addestramento personalizzato per ogni utente o addirittura impianti chirurgici, il braccialetto di Meta è progettato per funzionare subito, senza personalizzazioni. Gli scienziati dichiarano infatti che il modello IA ha un’elevata capacità di generalizzazione, riuscendo a interpretare i segnali muscolari di utenti diversi con precisione accettabile fin dal primo utilizzo.

“A nostra conoscenza, si tratta della prima interfaccia neuromotoria ad alta banda con capacità di generalizzazione immediata su larga scala”, scrivono i ricercatori nell’articolo su Nature. Per raggiungere questo traguardo, il team ha sviluppato un’infrastruttura di raccolta dati su larga scala, coinvolgendo oltre 300 volontari in attività come spostamento del cursore, selezione di comandi e scrittura a mano libera. Il risultato è un dataset di oltre 100 ore di registrazioni sEMG, che Meta ha deciso di rendere pubblicamente disponibile per incoraggiare ulteriori ricerche.

Scrittura a mano e comandi gestuali

Tra le funzionalità più affascinanti c’è la capacità di scrivere parole sullo schermo usando semplici movimenti della mano rilevati al polso. Attualmente, la velocità di scrittura raggiunta è di circa 20,9 parole al minuto, inferiore rispetto ai circa 36 WPM delle tastiere mobili e ai 40+ WPM dei dattilografi esperti, ma comunque promettente per un sistema ancora in fase prototipale.

Oltre alla scrittura, il braccialetto permette di eseguire comandi gestuali come click, selezioni e navigazione, rendendolo un’interfaccia adatta anche all’impiego in ambienti di realtà aumentata o realtà virtuale, dove le mani sono spesso in movimento e l’interazione diretta con schermi o tastiere è impraticabile.

Secondo gli autori dello studio, il sistema potrebbe essere adattato per aiutare persone con disabilità motorie a interagire con computer e dispositivi digitali, precisando però che le versioni attuali del modello sono state addestrate su soggetti normodotati e non è ancora chiaro se le stesse prestazioni si possano replicare in popolazioni cliniche con esigenze particolari. Per chi non risponde bene ai modelli generici, sarà comunque possibile personalizzare il sistema, con un miglioramento medio delle prestazioni del 16% nei test condotti finora.

Interfacce del futuro: leggere i muscoli, non le intenzioni

L’invenzione di Meta si inserisce in un filone di ricerca che guarda al corpo umano non solo come strumento di input fisico, ma come fonte di segnali neurali interpretabili. Dove finora abbiamo usato mani, dita, occhi e voce per controllare la tecnologia, il futuro potrebbe essere dominato da interfacce invisibili, che leggono direttamente le intenzioni motorie.

L’approccio scelto da Meta (nessuna videocamera e nessun impianto chirurgico ma un semplice wearable Bluetooth) rappresenta un compromesso efficace tra usabilità, accuratezza e non invasività e, in un panorama dominato da esperienze IA sempre più immersive, la possibilità di controllare un computer solo con piccoli movimenti della mano potrebbe ridefinire il concetto stesso di interfaccia utente.

Per ora, il braccialetto è ancora un prototipo, ma il rilascio pubblico dei dati e la pubblicazione su Nature indicano che Meta intende aprire la strada a un nuovo standard per il controllo muscolare dei dispositivi digitali. Un passo in avanti non solo per l’innovazione tecnologica, ma anche per una maggiore inclusività nell’accesso all’informatica e alle esperienze immersive del futuro.